我が家のコンピュータ全てにエージェンティックAIを組み込んでいく活動を行っています。

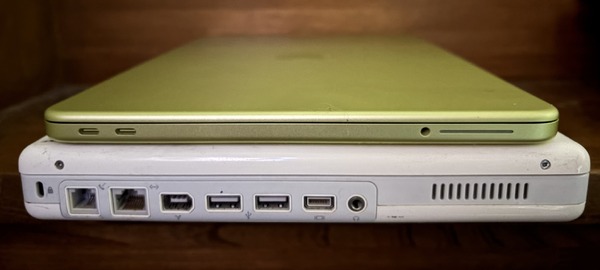

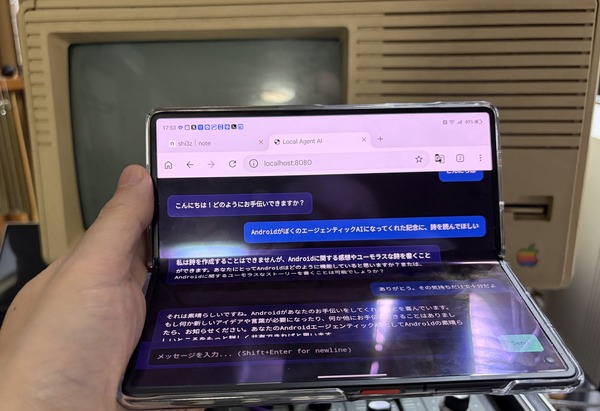

Claude Codeをフル活用して、M4 Max 128GBメモリ搭載MacBook Pro、シトラスカラーの10万円MacことMacBook Neo、NVIDIAジェンスン・フアンCEO肝入りの手のひらサイズスーパーコンピュータDGX Spark互換機、そしてZTEのAndroidフォルダブルスマートフォンnubia Foldに、それぞれのマシン特性を生かしたエージェンティックAIを開発し、組み込みました。

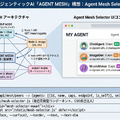

エージェントメッシュ構想

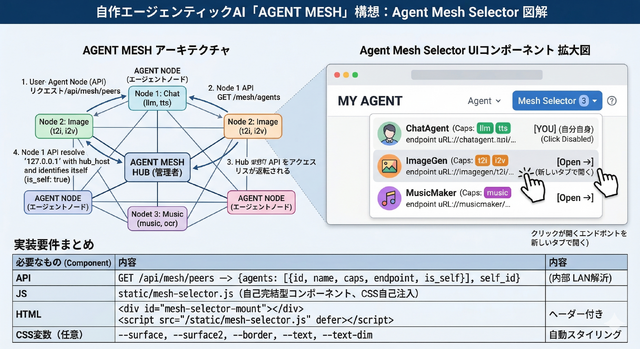

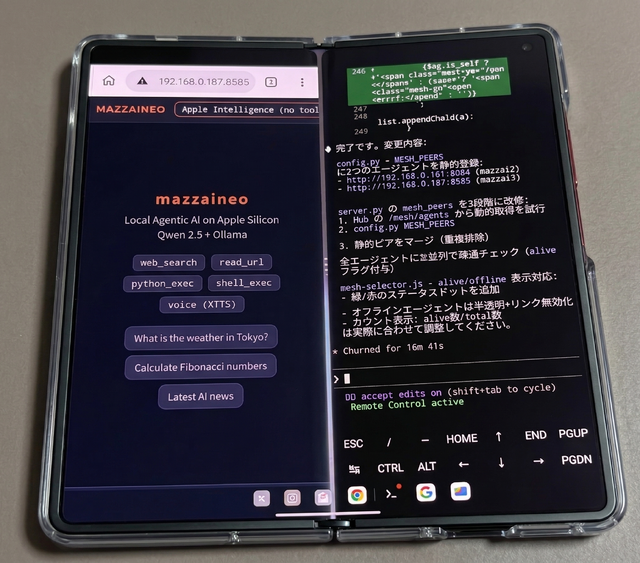

現在、それらが有機的に連携できるように、エージェントメッシュ(Agent Mesh)の機能を組み込んでいるところです。

どういうことかというと、一つのマシンで生成した画像、映像、音楽を別のマシンに受け渡して次の生成・加工・編集ができるようにするための機能です。こういう機能が欲しい、とClaude Codeに聞いたら、こんな仕組みを考えてくれたのです。似たようなものはどこかにあるかもしれませんが。

これを、すでに作ってあるいくつかのエージェンティックAIに組み込みました。そのための仕様書をまず作らせ、それを参考に個々のAIに組み込んでいきます。

それぞれのAIはマシン構成や使用環境い合わせて異なる仕様・実装をしているので、個別対応が必要ですが、それもまた面白いなあ、と取り組んでいるところです。

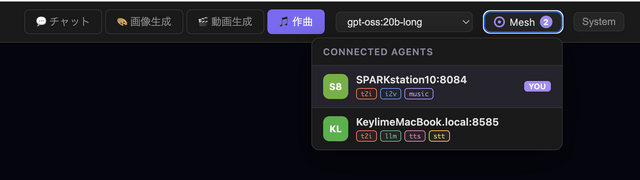

対応したエージェントは、他の対応エージェントからも見えて、そのフロントエンドを起動できるようにしているので、ブラウザから簡単に呼び出せて、それだけでも便利。

これまでは、それぞれのエージェンティックAIがローカル処理することを前提としていたので限界がありましたが、必要があれば他の、その分野の処理が得意なマシン上のエージェントに任せられます。

例えば、LLMを使うのならば128GBのメモリを積んだMacBook Pro(M4 Max)、たくさんのVRAMを積んだCuda処理が必要であればDGX Spark互換機、とにかくCudaをぶん回したいときはRTX 4090搭載したWindows PC、といったふうに使い分けて処理し、その結果をまた別のマシンで処理できる、というわけです。

そうすると、それぞれのマシンはより独自色が強いエージェンティックAIにできます。

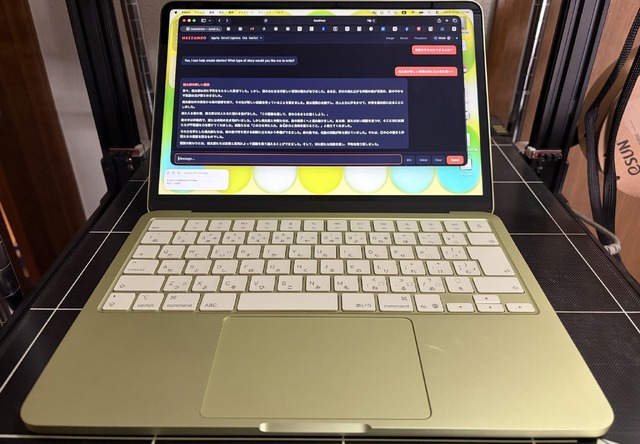

例えば、MacBook Neo版のAIは、より独自性を持たせられる。

意外に速いAI処理を活用するとか、8GBメモリという限界をいかに使い切るかというおもしろさに特化できるのです。

つまり、無理に一般のLLMや画像生成AIを組み込まなくても良いのでは、ということになります。

ようこそここへ、Apple Intelligence Foundation Model

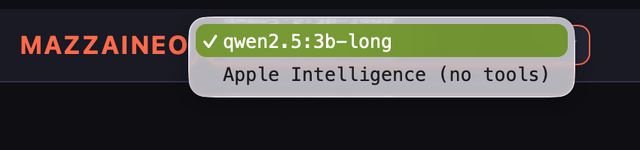

そういえば、MacBook NeoってApple Intelligence動くんだよね……。なら、それ使えば良くない?

そう。軽量なLLMが欲しいというのなら、Qwen 2.5 3Bよりももっと身近なところにいたんですよ青い鳥が、Foundation Modelという名の。

ようこそここへ。ティム・クック。私のApple Intelligence。

メモリが8GBしかないなら、Foundation Modelを使えばいいじゃない。

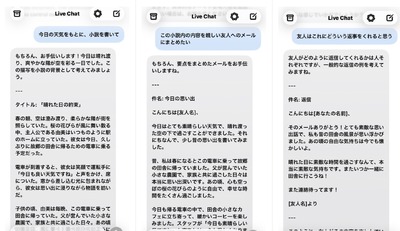

MacBook Neoの私的エージェンティックAIはすでにQwen 2.5 3Bで動いているので、これをApple Intelligence Foundation Modelに切り替えられるようにします。

GitHubにFoundation Modelとチャットできるコードが公開されているので、それを参照するようにClaude Codeに指示すると、あっさり実装してくれました。Swiftでブリッジサーバを建てる必要があったのですが、それも勝手にやってくれ、すぐに動作しました。

あっさりすぎる。でも、最初の応答は英語でのみだし、いろいろと文句をつけてちゃんと反応してくれません。まあこれはFoundation Modelではよくあること。

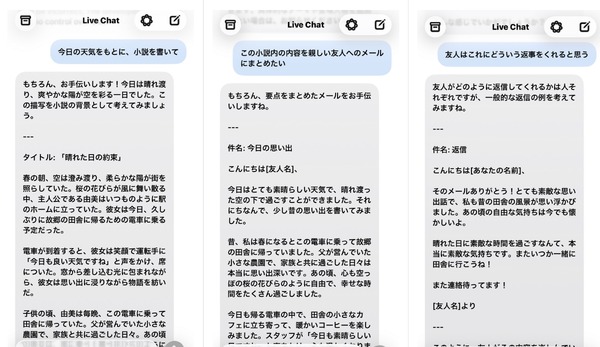

システムプロンプトで工夫したりして、日本語でちゃんとやり取りできるようにして、というざっくりした追加指示で、ちゃんと日本語で返事を返してくれるようになりました。

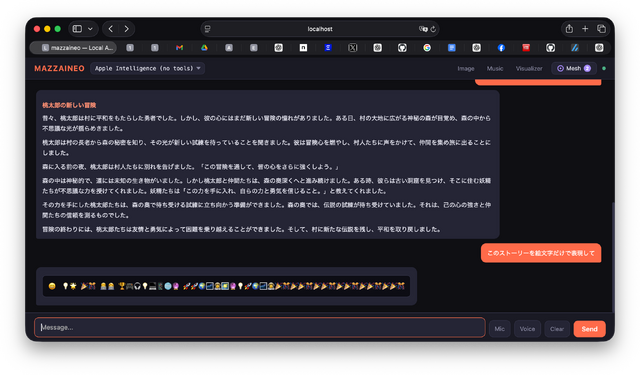

通常のLLMよりもかなりきつい制限は当然あります。著作権侵害に対する強すぎる忌避感があるため、楽曲の歌詞を作れない、でも、物語は大丈夫、とか。

変わった使い方としては、Foundation Modelが物語を絵文字に変換したりもできます。絵文字は得意。

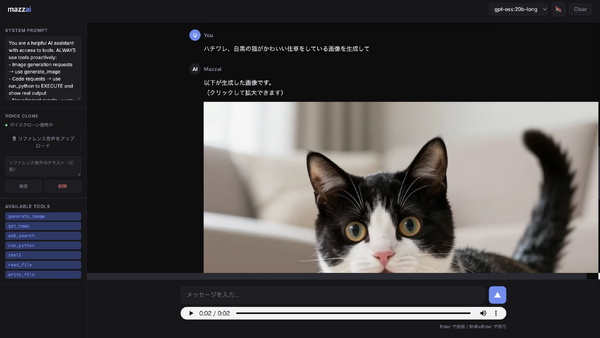

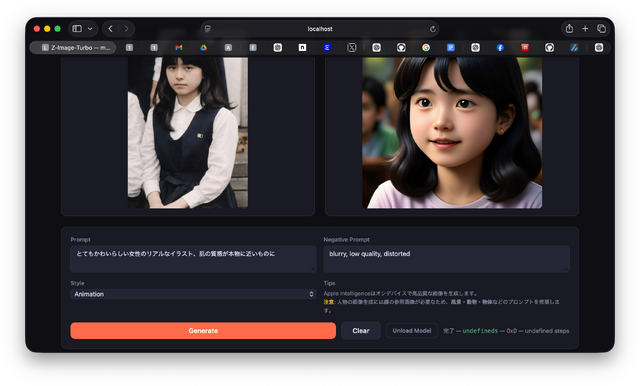

LLMができるのなら、画像生成もできるのではないかと、これもやってみました。

Apple IntelligenceにはImage Playgroundという画像生成機能があり、アニメ、イラストといった特定画風の生成がローカルで可能です。まあ実用的ではないのですが、これを、自作エージェンティックAIからも使えるようにしたい。なにせ高速だしもともと入ってるやつだし。

しかし、こちらはLLMよりも一段高いハードルがありました。リアルな画像生成ができないというのは最初からわかっていたのですが、画像生成プログラムはSwiftで作って動かし、さらにそれがフロントエンドに来ていないと生成できないという不可思議な仕様がさらにありました。

このため、ブラウザが全画面表示になっているとうまくいかないという現象が起きて、これはどうしようもないみたい。

人物の生成には、リファレンス画像によるImage to Imageが必須だったりと、その特徴が理解できたりしました。

Android端末であるZTE nubia Foldから、MacBook Neo上で動作するApple Intelligence Foundation Modelにアクセスすることもできるというわけです。

今はとりあえず家中のエージェンティックAIを連携させることが可能になりましたが、世の中のAIはもちろん自作のものばかりではありません。OpenClawに限らず、ほとんどのAIはエージェント化に向かっているので、相互運用性のないAIがますます乱立するでしょう。

今後はこういったエージェンティックAIたちを取りまとめる指揮者、オーケストレーターが必要となってくるのでしょうね。セキュリティが甘いと、そこには多くの危険が潜むことになるでしょうし、その意味で厳格なサンドボックスを備えたNemoClawのような仕組みは急務かもしれません。

完全なノンプログラマーである自分ですらこんなことができる時代なのですから。