1週間の気になる生成AI技術・研究をいくつかピックアップして解説する連載「生成AIウィークリー」から、特に興味深いAI技術や研究にスポットライトを当てる生成AIクローズアップ。

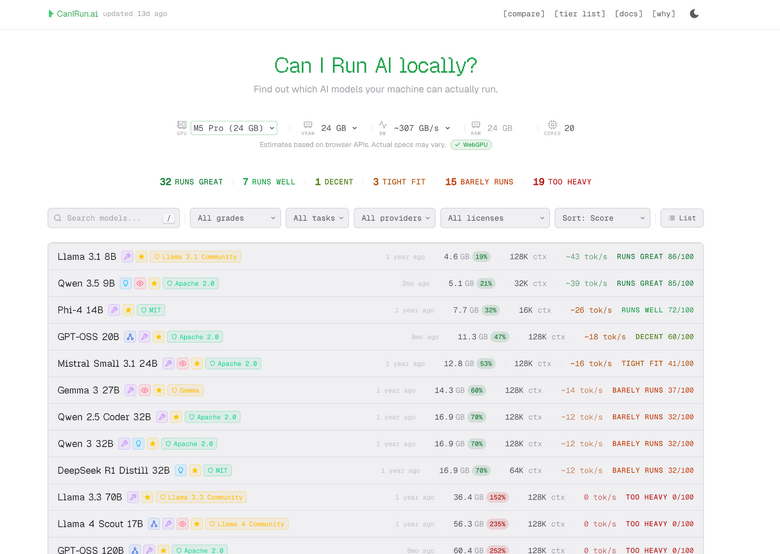

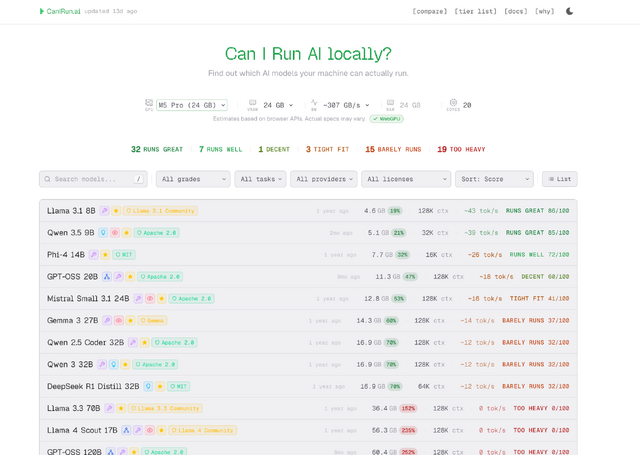

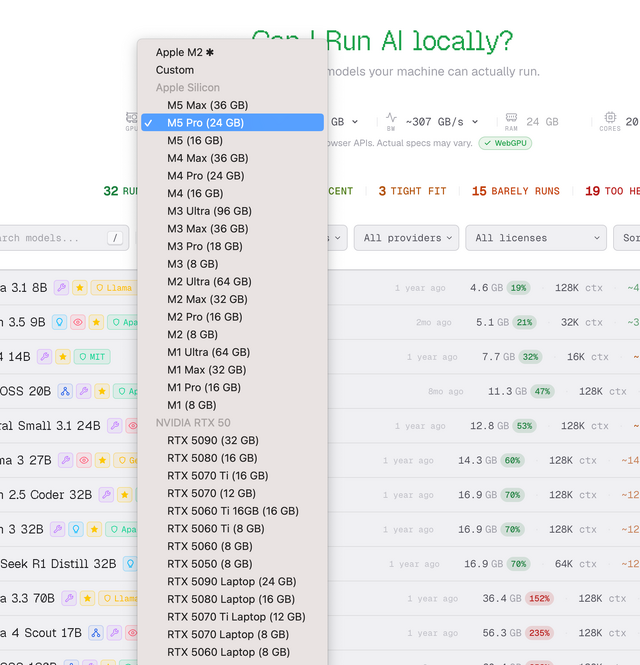

今回は、サイトに訪問するだけで自分のPCでどのAIモデルがローカル動作するかを判定してくれるサイト「CanIRun.ai」(Can your machine run AI models?)を取り上げます。

▲Apple M5 Pro 24GBでのcanirun.aiトップ画面

▲さまざまなデバイスで試せるため、デバイス購入前に確認することもできる

開発者midudev氏が、手元のマシンでどのAIモデルが実際に動かせるのかを一瞬で判定できるWebサービス「CanIRun.ai」を公開しました。インストールや登録は一切不要、サイトにアクセスするだけでGPUやメモリを自動検出して、各モデルに対する動作判定を6段階で色分けして表示してくれます。

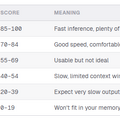

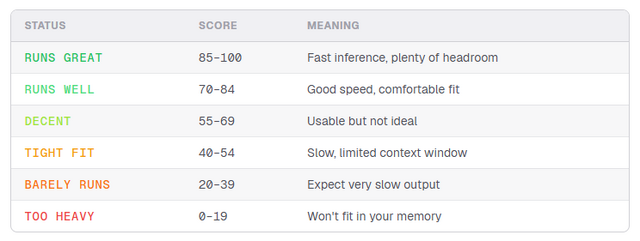

Runs great(快適に動作)高速な推論:85~100点

Runs well(良好に動作)スピードも良く快適:70~84点

Decent(まずまず動作)使用可能だが理想的ではない:55~69点

Tight fit(余裕なし)動作が遅く、コンテキストウィンドウが限定的:40~54点

Barely runs(かろうじて動作)非常に遅い出力が予想される:20~39点

Too heavy(動作不可):0~19点

▲スコアに応じて6段階のステータスが緑~赤のグラデーションで色分けされる

仕組みとしては、WebGL・WebGPU・navigatorの各APIでGPU名・CPUコア数・搭載RAMを取得し、約40種類のGPUおよびApple Silicon約12種類の内蔵データベースと照合することで、VRAM容量やメモリ帯域幅を推定します。そのうえで各モデルの量子化別VRAM要求量を計算し、推論速度55%、メモリ余裕度35%、品質ボーナス約10%の配分で0から100点のスコアを算出する仕組みです。

▲CanIRun.ai の判定フロー

収録モデルは、Llama、Qwen、Gemma、Phi、Mistral、Mixtral、DeepSeek、GPT-OSS、Kimi K2など主要どころを網羅し、ライセンスやコンテキスト長、推定トークン毎秒まで併記されています。

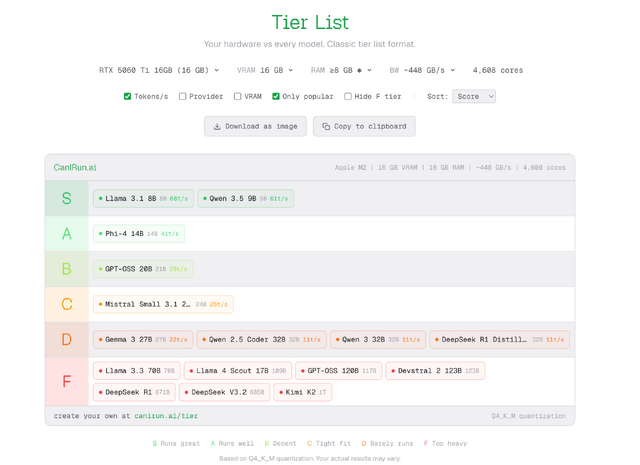

他にも、2台のデバイスを比較できる「Compare」、S~Fランクでモデルを振り分ける「Tier List」も試せます。

▲NVIDIA GeForce RTX 5060 Ti 16GBでのTier List表示画面

すべての結果はあくまで推定値であり、GPU名は曖昧な場合があったり、RAMの値は概算値であり、帯域幅の数値は実際の測定値ではなく仕様書に基づいているに過ぎなかったりと限界はあります。厳密な保証ではなく、だいたいこのくらい動くはずという目安として捉えるのが健全です。