1週間の気になる生成AI技術・研究をいくつかピックアップして解説する連載「生成AIウィークリー」から、特に興味深いAI技術や研究にスポットライトを当てる生成AIクローズアップ。

今回は、2026年5月にHugging Face上で公開された、無検閲(Uncensored)オープンソース動画生成モデル「Sulphur 2」を取り上げます。

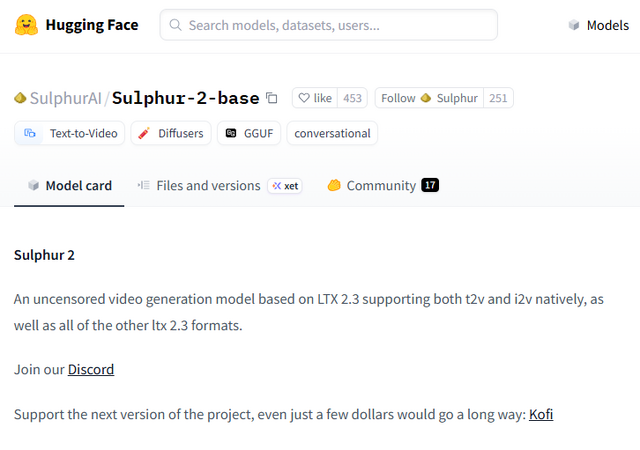

▲Hugging Face上に公開されているSulphur 2のスクリーンショット

このモデルは、LTX 2.3をベースに無検閲版にファインチューニングされたものでパラメータ数は90億、テキストから動画を生成するText-to-Videoと画像から動画を生成するImage-to-Videoの両方をネイティブにサポートしています。

開発者であるFusionCow氏がRedditのr/StableDiffusionに投稿した告知によると、学習データには10秒・24fpsの動画12万5千本が使用されており、フィルタリングは違法コンテンツと2Dアニメーションを除外する形で実施。2Dを除外した理由については、含めるとモデル全体の性能が低下することが確認されたためと説明されています。

なお、第一世代となるSulphurはLTX 2.0を4万本の動画でファインチューニングしたものでしたが、結果に満足できなかったため、LTX 2.3の登場を機に学習データを大幅に拡充して作り直されたという経緯があります。

データセットの総容量は約500GBで、キャプション付与の処理にはGoogleのGemini 3 Flashが用いられ、その費用はおよそ700ドル。GPUのレンタル費用は約8000ドルで、その他の経費を加えるとプロジェクト全体ではさらに上回る金額になったそうです。匿名の支援者たちがおり、支援者なしでは実現しなかったと述べています。

派生プロジェクトとしては、TenStrip氏による「LTX2.3-10Eros」が並行して公開されました。こちらはSulphur 2をベースにImage-to-Video用途へ最適化したモデルです。