この1週間の気になる生成AI技術・研究をいくつかピックアップして解説する今回の「生成AIウィークリー」(第141回)は、家庭用PCで動く商用利用可能なBaidu開発の画像生成AI「ERNIE-Image」や、Opus 4.6に迫るコーディング性能のAIモデル「MiniMax M2.7」のオープンウェイト化を取り上げます。

また、1枚の画像からゲーム向け3Dワールドを生成できるAIモデル「HY-World 2.0」と、アリババが発表したオープンウェイトAIモデル「Qwen3.6-35B-A3B」をご紹介します。

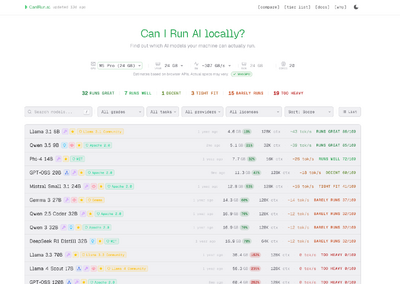

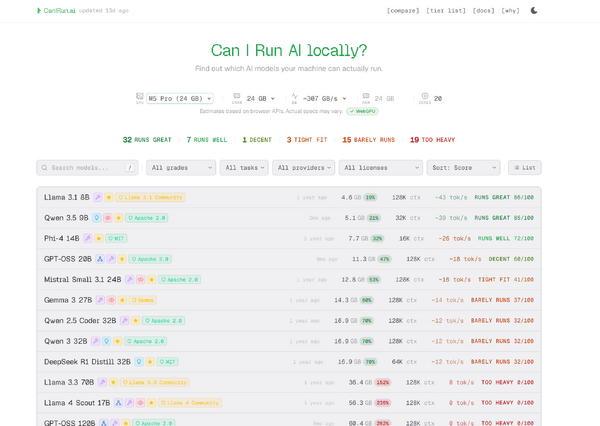

そして、生成AIウィークリーの中でも特に興味深いAI技術や研究にスポットライトを当てる「生成AIクローズアップ」では、サイトに訪問するだけで自分のPCでどのAIモデルがローカル動作するかを判定してくれるサイト「CanIRun.ai」を別の単体記事で取り上げています。

Opus 4.6に迫るコーディング性能、AIモデル「MiniMax M2.7」がオープンウェイトで公開

中国のAI企業MiniMaxが3月に発表した新モデル「MiniMax M2.7」のオープンウェイトがHugging FaceとModelScopeで公開されました。

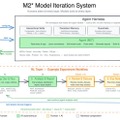

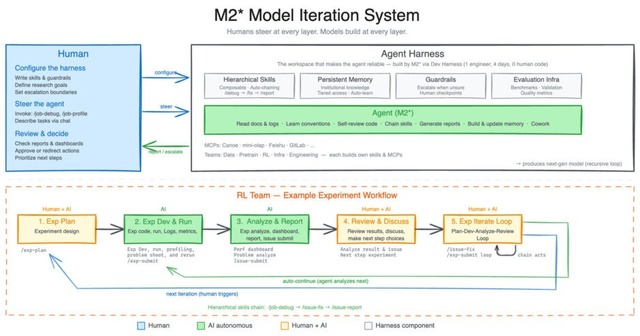

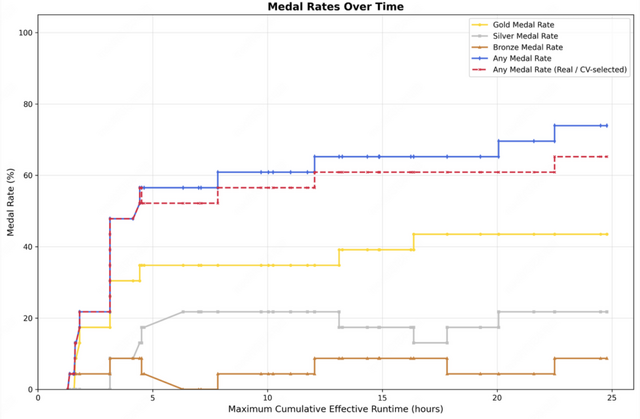

M2.7は2290億総パラメータのMoEモデルで、推論時に活性化されるのは100億パラメータです。モデル自身が自分の改良サイクルに参加する自己進化を取り入れています。

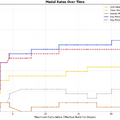

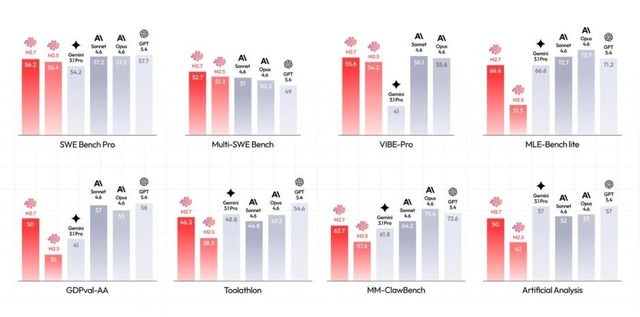

ベンチマーク成績は、ソフトウェア開発のSWE-Proで56.22%を記録し、GPT-5.3-Codexと同等、Claude Opus4.6に肉薄するスコアとなっています。Terminal Bench 2では57.0%、リポジトリ単位のコード生成を測るVIBE-Proでも55.6%とOpus 4.6に肉薄しています。オフィス業務を評価するGDPval-AAではELO 1495を獲得し、オープンソースモデルの中では最高値となっています。

ライセンスは非商用利用で、商用利用する場合には事前許諾が必要です。

MiniMax M2.7

MiniMax team

Blog | Hugging Face

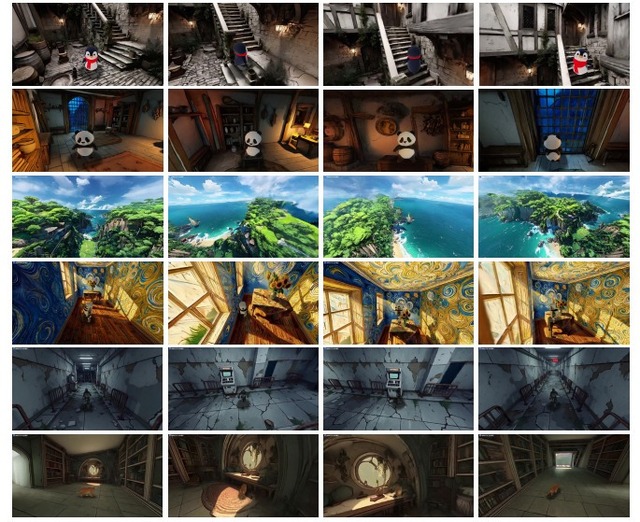

1枚の画像からゲーム向け3Dワールドを生成できるAIモデル「HY-World 2.0」をテンセントが公開

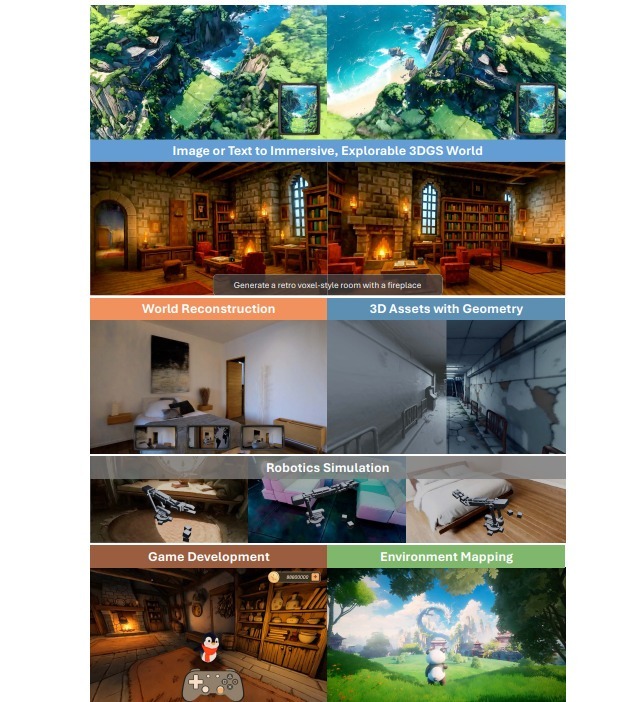

Tencent Hunyuanが「HY-World 2.0」という世界モデルを公開しました。テキストや1枚の画像から、歩き回れる3D世界をまるごと生成できるのが特徴です。

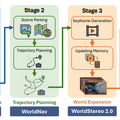

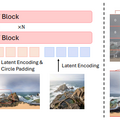

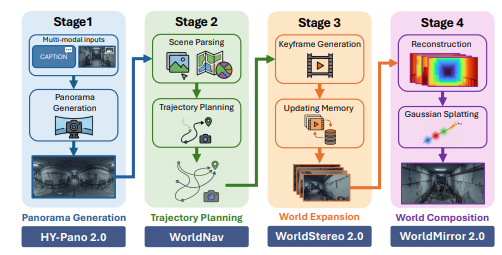

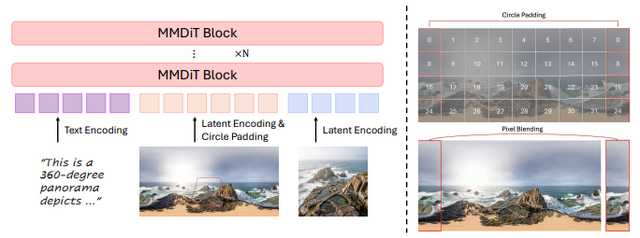

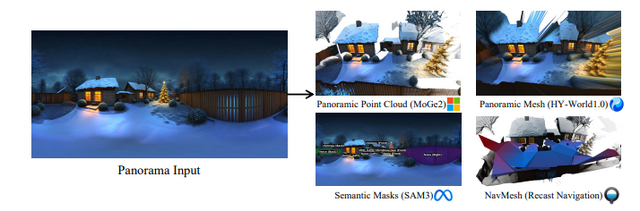

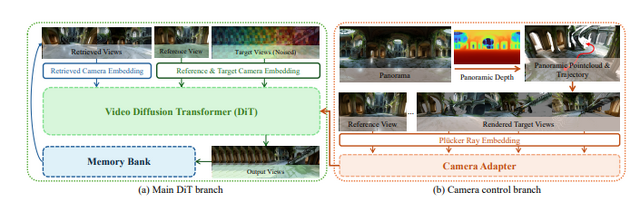

仕組みは4段階で、まずHY-Pano 2.0が入力から360度パノラマを作り、世界の土台を用意します。次にWorldNavがそのシーンを解析して、障害物を避けつつ死角を減らすカメラ経路を自動で計画します。続いてWorldStereo 2.0がその経路に沿って新しい視点の画像を次々に生成し、最後にWorldMirror 2.0が生成画像から3D構造を復元して、3D Gaussian Splattingによる最終的な世界を組み立てます。

ポイントは、生成と再構築という本来別物の2つを1つのシステムに統合したこと、そしてキーフレーム単位の生成と記憶機構によって視点が大きく動いても破綻しにくくなったことです。

結果として、既存のオープンソース手法を各種ベンチマークで上回り、クローズドソースの商用モデルMarbleとも互角に渡り合う品質を、NVIDIA H20 GPU一台でおよそ10分という速度で実現しています。

HY-World 2.0: A Multi-Modal World Model for Reconstructing, Generating, and Simulating 3D Worlds

Team HY-World, Chenjie Cao, Xuhui Zuo, Zhenwei Wang, Yisu Zhang, Junta Wu, Zhenyang Liu, Yuning Gong, Yang Liu, Bo Yuan, Chao Zhang, Coopers Li, Dongyuan Guo, Fan Yang, Haiyu Zhang, Hang Cao, Jianchen Zhu, Jiaxin Lin, Jie Xiao, Jihong Zhang, Junlin Yu, Lei Wang, Lifu Wang, Lilin Wang, Linus, Minghui Chen, Peng He, Penghao Zhao, Qi Chen, Rui Chen, Rui Shao, Sicong Liu, Wangchen Qin, Xiaochuan Niu, Xiang Yuan, Yi Sun, Yifei Tang, Yifu Sun, Yihang Lian, Yonghao Tan, Yuhong Liu, Yuyang Yin, Zhiyuan Min, Tengfei Wang, Chunchao Guo

Project | Paper | GitHub

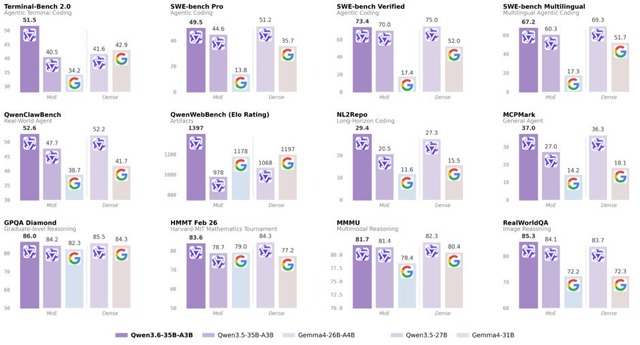

大型モデルGemma4-31Bに匹敵する精度、オープンウェイトAIモデル「Qwen3.6-35B-A3B」をアリババが発表

アリババのQwenチームは、新たなオープンウェイトモデル「Qwen3.6-35B-A3B」を発表しました。これは総パラメータ数350億、アクティブパラメータ数30億というMixture-of-Experts(MoE)モデルです。

効率的な構造でありながらエージェント的なコーディング性能が高いことが特徴です。前世代のQwen3.5-35B-A3Bを上回り、より大規模なモデルであるQwen3.5-27BやGemma4-31Bにも匹敵する結果を示しています。

ベンチマークでは、SWE-bench Verifiedで73.4、Terminal-Bench2.0で51.5、QwenWebBenchで1397といった高いスコアを記録しており、特にエージェント系コーディングタスクでの強さが際立っています。

マルチモーダル面でも自然に対応しており、視覚言語タスクの多くでClaude Sonnet 4.5と同等、もしくは上回る性能を見せています。

Qwen3.6-35B-A3B

Qwen team

Project | Hugging Face

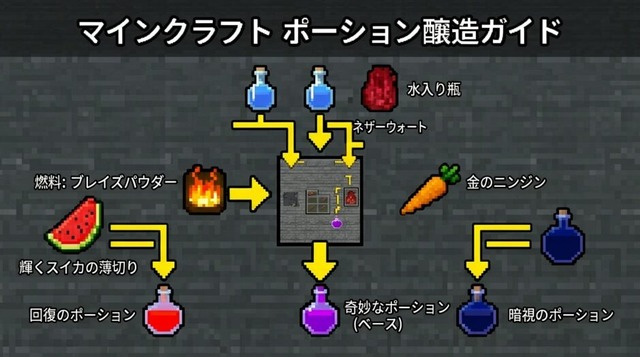

Nano Banana 2.0に肉薄、日本語セリフが得意で商用利用OKなローカル画像生成AI「ERNIE-Image」をBaiduが発表

Baiduが、テキストから画像を生成するオープンウェイトモデル「ERNIE-Image」を公開しました。8BパラメータのDiT(Diffusion Transformer)を採用したコンパクトなモデルです。

このモデルの持ち味は見栄えの良さだけでなく、指示通りに作れる制御性にあります。複雑なプロンプトへの追従、ポスターや漫画のコマ割りのようなレイアウト重視の生成、中国語・英語を含む多言語の長文テキスト描画を得意としており、日本語もほぼ文字化けせずに出力できます。

ベンチマークでは、GenEvalで1位、LongTextBenchとOneIG-ZHで2位、OneIG-ENで3位と、Nano Banana 2.0やSeedream 4.5などのクローズドモデルと互角に渡り合い、オープンウェイトモデルに限ればどの指標でも首位となりました。

運用面では、8Bというサイズなため24GB VRAMの民生GPUで動作します。通常版のERNIE-Imageと高速化版のERNIE-Image-Turboの2種類がHugging Face上で公開されています。

短い入力文を詳細なプロンプトに展開する3B Prompt Enhancerも同梱されています。

ERNIE-Image

Baidu

Project | Hugging Face