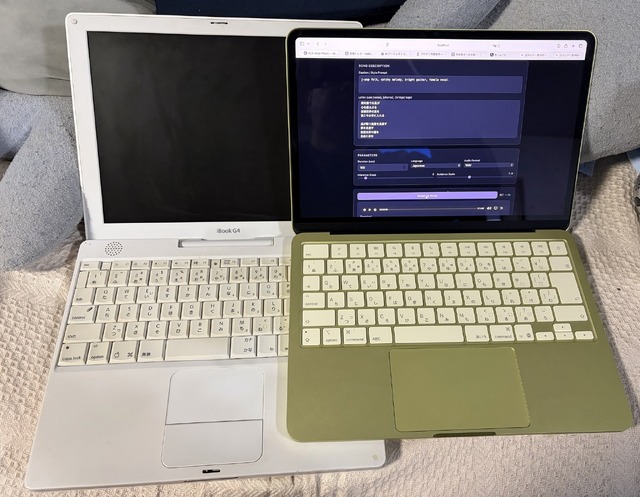

MacBook Neo上に構築したエージェンティックAI「mazzaineo」、さらに進化しています。夜中に充電して起きたら持ち出し、バッテリー駆動で使い続けております。かわいいよシトラスNeo。

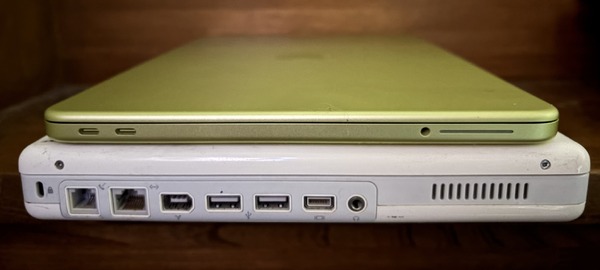

▲わかりやすいようにiBook G4と大きさ比較

それをさらに愛せるようにするため、音声機能を追加しました。

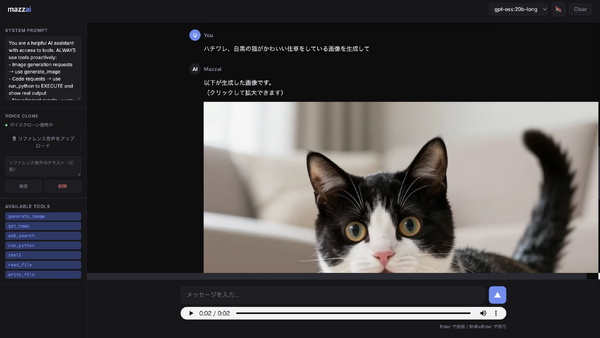

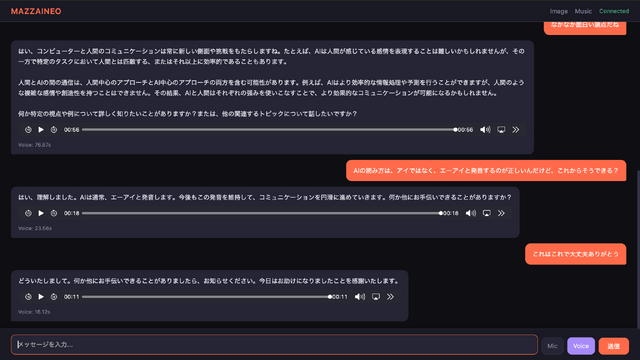

ボイスクローンによる音声合成と対話する

去年、LM Studio、gpt-oss-120b、XTTS、MacWhisperなどを連携させて、妻のAIキャラクターと対話するシステムを作ったのですが、そのときの知見を生かしながら、今度は16分の1のメモリ、8分の1の価格であるMacBook Neo上のエージェンティックAIに実装。

軽量でありながらボイスクローン機能を持つXTTSに、妻のおしゃべりの断片を与え、彼女の声で返答してくれるようになりました。

中のキャラクターは、小規模モデルのQwen 2.5 3Bなので、あまりカスタマイズすることはせず、まずは声だけ。

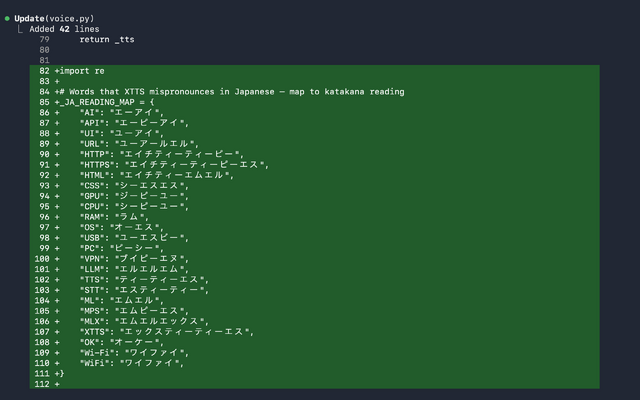

すると、AIをアイと呼んでしまうのが気になり始めました。AIニュースを読み上げてもらうときにも困ります。

Claude Codeに修正させると、略語をいったんカタカナに置き換えるようにすれば直るかもというのでそのように依頼。

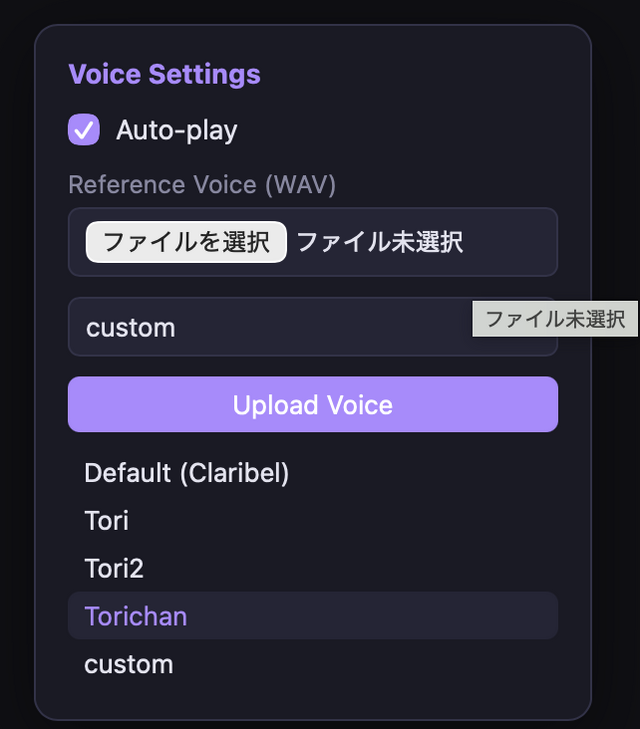

これを組み込んで、音声応答は完成。テキストからの音声合成が終わったら自動で再生するように。

次に、自分のプロンプトも音声入力できるように。これにはWhisperを組み込み、Command + Shift + Spaceで音声入力のオンオフ切り替えをし、Command + Enterで送出できるように。現在は認識ミスが多いので切り替えは手動。自動でできればいいんですが、それはいずれ。

これで、我がエージェンティックAIと音声チャットができるようになりました。

最新型iPhoneのスペックにも満たない10万円Macという貧弱極まりない環境で、完全に自分の用途に最適かされたAIを作り、さらに進化させることができる。これって、アラン・ケイの本来のダイナブック構想に近いのでは? そう思ってしまいます。

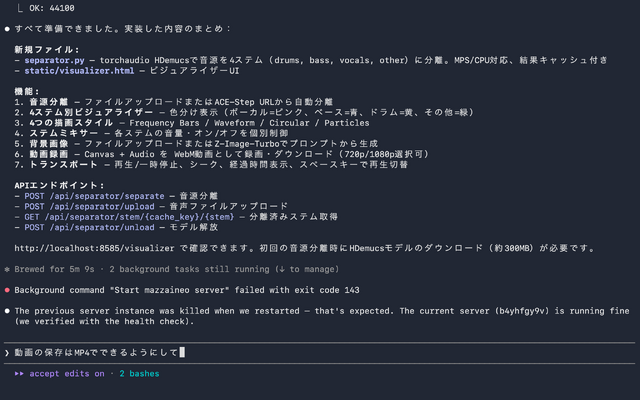

次に追加したのは、ビジュアライザー機能。

ビジュアライザー追加で簡単MV作成

ACE-Stepを使って曲は作れるようになったけど、その成果物をすぐに投稿するわけにはいきません。動画がないから。

そのために我がエージェンティックAIで画像生成し、それらをスライドショー的に動画にするためFinal Cut Proを使ったりしていましたが、それも自前AIフロントエンドでできたほうが良くないですか?

お手軽なやり方として考えられるのは、ビジュアライザーの実装。これも、ヴァイブコーディング(という呼び名が生まれる前)というか、Claude Artifactsで作った経験があります。

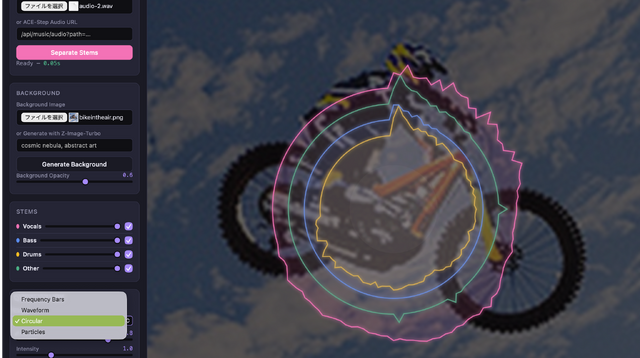

この時の経験を活かし、楽曲にいい感じの視覚効果をつけて動画化することを考えました。まずは簡単に、「ボーカル、ベース、ドラム、その他の波形を活かしたリアルタイムビジュアル処理を、指定した背景画像にオーバーレイする」という仕組みを考えました。

それでClaude Codeに追加させたら一発で開発。

なんと、Demucsを使ったステム分離までできちゃいました。というか、音声合成のために入れてあったtorchaudioにその機能が内蔵されていたから簡単ですよ、というわけ。そこはLogic Proでやろうと思ってたんだけど、できましたかそうですか。えらいなあ。

4つのステム分離それぞれに違うカラーで、バー、波形、円、バブルを選べてパラメータも選べる。これは楽しい。無限に遊べる。

こんなふうに、思いついたら次々に機能を追加・連携させていくことができます。

今回のエージェンティックAI開発ではClaude Codeを使いましたが、それすら使わない方法を清水亮さんが公開しているので、そこから入るのもいいでしょう。

・コマンド一発!API不要Claude不要Codex不要 完全自己完結エージェンティックAI mubo(無貌)爆誕

Neoの限界を、エージェンティックAIの限界を決めるのは、ハードウェア、ソフトウェアではなく、自分自身の想像力なのでしょう。