この1週間の気になる生成AI技術・研究をいくつかピックアップして解説する「生成AIウィークリー」。

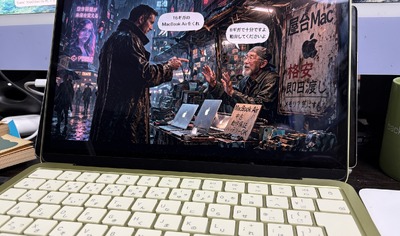

第139回では、国立情報学研究所がオープンソースで公開した大規模言語モデル「LLM-jp-4」や、Netflixなどが開発の動画から物体を消すと世界も変わる技術「VOID」を取り上げます。

また、LLMのハーネス設計を自動最適化する「Meta-Harness」や、推論精度はほぼ維持したままスマホで動く1ビットLLM「Bonsai 8B」をご紹介します。

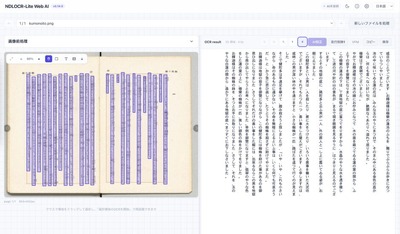

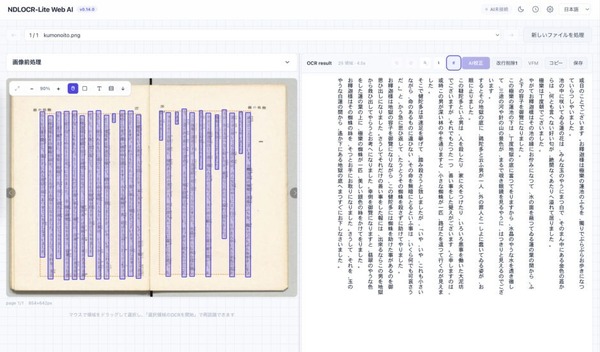

そして、生成AIウィークリーの中でも特に興味深いAI技術や研究にスポットライトを当てる「生成AIクローズアップ」では、Webブラウザだけで日本語OCR(光学文字認識)が完結するツール「NDLOCR-Lite Web AI」を別の単体記事で取り上げています。

「動画から人を消したら、持っていた風船は飛んでいく」 動画から物体を消すと世界も変わる技術「VOID」をNetflixなどが開発

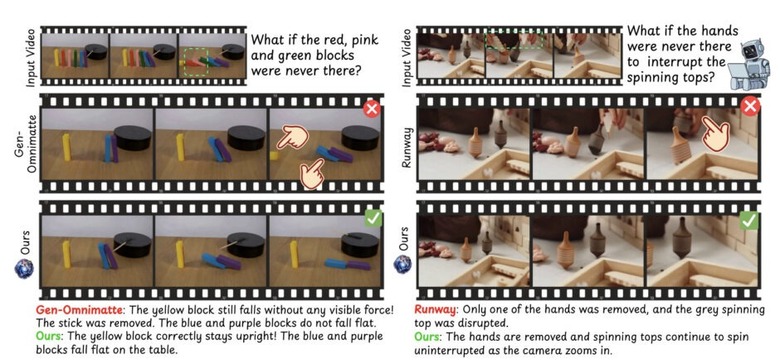

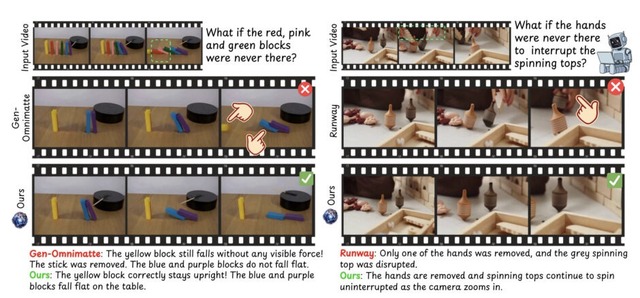

動画から特定の物体を消す技術は、消した物体の後ろ側を埋めたり、影や反射を消したりするだけなら既存の手法でも対応できます。

しかし、物体同士がぶつかったり支え合ったりしている場合、消した後の世界を物理的に正しく描き直すのは難しい課題でした。例えば、ドミノの列から途中の数枚を消せば、その先は倒れないはずですが、従来の手法ではそのまま倒れ続けてしまいます。

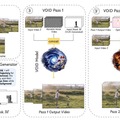

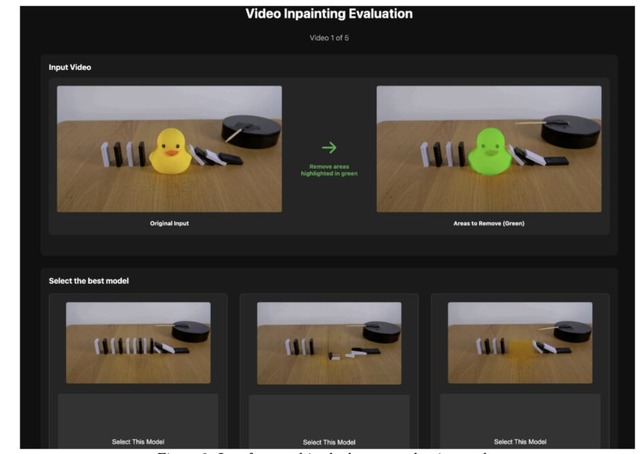

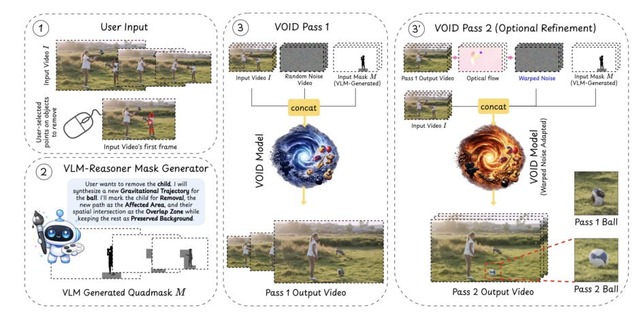

Netflixなどの研究チームが発表した「VOID」は、この問題に取り組んだフレームワークです。物理シミュレーションエンジンや人体モーションキャプチャデータセットを使って「物体がある動画」と「ない動画」のペアを大量に生成し、除去後に周囲がどう変化すべきかを学習しています。

推論時には、視覚言語モデル(VLM)が入力映像を解析し、除去対象が影響を及ぼしている領域を空間的に特定します。この情報は動画拡散モデルへの条件付けとして機能し、影響を受ける領域のみを物理法則に沿って再合成するよう誘導します。

実世界の動画75本を使った評価では、VOIDが64.8%の支持を獲得し、Runwayの18.4%を引き離しました。さらに汎化能力で、風船を持つ人を消すと風船が空へ浮かんでいったり、ミキサーを押す人を消すとミキサーが動かなくなったりと、訓練データにない物理現象にも正しく対応できています。

VOID: Video Object and Interaction Deletion

Saman Motamed, William Harvey, Benjamin Klein, Luc Van Gool, Zhuoning Yuan, Ta-Ying Cheng

Project | Paper | GitHub

国産LLM「LLM-jp-4」を国立情報学研究所がオープンソースで公開。GPT-4oやQwen3-8Bを上回るスコア

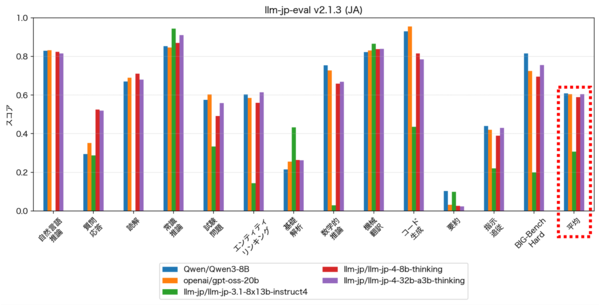

国立情報学研究所(NII)の大規模言語モデル研究開発センターは2026年4月3日、国産の大規模言語モデル「LLM-jp-4」の2つのモデルをオープンソースライセンスで公開しました。

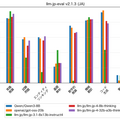

公開されたのは、約86億パラメータの「LLM-jp-4 8B」と、約320億パラメータのMoEモデル「LLM-jp-4 32B-A3B」の2種類です。

学習にはインターネット上の公開データや政府・国会の文書、合成データなどから構成される約12兆トークンのコーパスを使用しており、オープンソースAIの定義に配慮して第三者も入手可能なデータで構築されている点が特徴です。前世代の「LLM-jp-3.1」シリーズと比べて約6倍の規模になります。

性能面では、日本語理解力を測る「日本語MT-Bench」において両モデルともGPT-4oやQwen3-8Bを上回るスコアを達成しました。英語の「MT-Bench」でもこれらと同等以上の結果を示しています。

LLM-jp-4

国立情報学研究所(NII)

Project

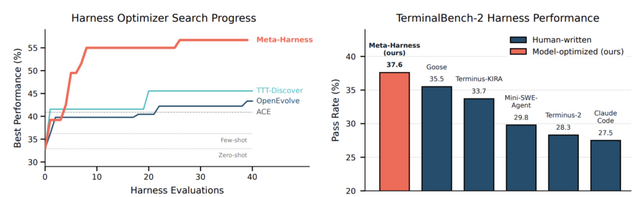

LLMの周辺コード“ハーネス”を全自動最適化する「Meta-Harness」をスタンフォード大などが開発

大規模言語モデルの性能は、情報の記憶や検索などを管理する周辺プログラム「ハーネス」の品質に大きく依存しますが、これまでその設計は人間の手作業に頼っていました。

スタンフォード大学などの研究チームが開発した「Meta-Harness」は、このハーネスコードの最適化を自動で行う新しいシステムです。

Meta-Harnessでは、最適化を担当するAIエージェントに対して、過去のコードや評価スコア、詳細な実行ログが保存されたファイルシステムへのアクセス権を与えます。要約されたフィードバックに頼る従来の自動化ツールとは異なり、AI自身が生のログを読み解いてどこで失敗したかを分析し、プログラム構造自体を書き直すことができます。

実験の結果、Meta-Harnessは人間の専門家が設計した既存システムを複数の分野で上回りました。オンラインテキスト分類では処理の軽量化と精度の向上を両立し、数学オリンピック級の推論や複雑な自律型エージェントのタスクにおいても、人間が調整した成績を上回りました。

Meta-Harness: End-to-End Optimization of Model Harnesses

Yoonho Lee, Roshen Nair, Qizheng Zhang, Kangwook Lee, Omar Khattab, Chelsea Finn

Paper

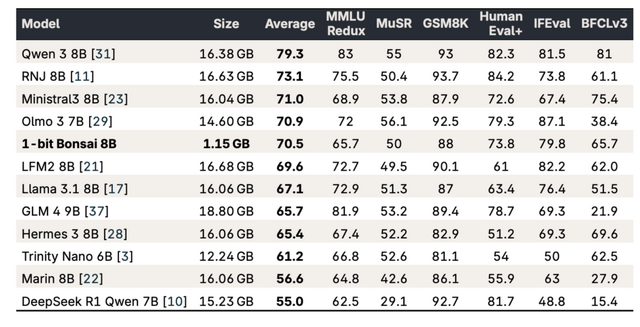

スマホで動く80億パラメータ、1ビットLLM「Bonsai 8B」、精度をほぼ維持しながら容量を最大14分の1に圧縮

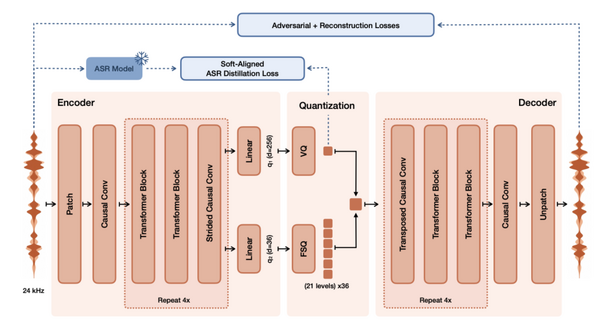

カリフォルニア工科大学(Caltech)発のAIスタートアップ企業「PrismML」が発表した「1-bit Bonsai 8B」は、AIモデルの重みを極限まで小さく表現することで、性能をほぼ保ったまま軽量化を実現したモデルです。

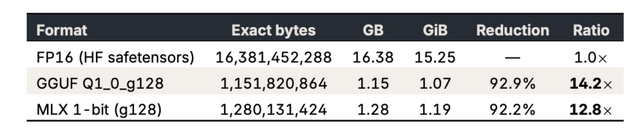

通常のAIモデルでは各重みを16ビット(FP16)の浮動小数点数で保持していますが、これに対しBonsaiは、各重みをプラスかマイナスかの1ビットだけに削ぎ落とし、128個の重みごとに大きさの目安となるスケール値を1つだけ共有する方式を採用しました。

細かな数値の違いは捨てつつ、グループ単位で大まかな大きさを残すことで、実用的な精度を保っています。その結果、フル精度モデルのQwen3-8Bで通常約16.38GB必要な容量が、1-bit Bonsai 8Bはわずか約1.15GB(最大14.2倍の縮小)というコンパクトさを実現しました。

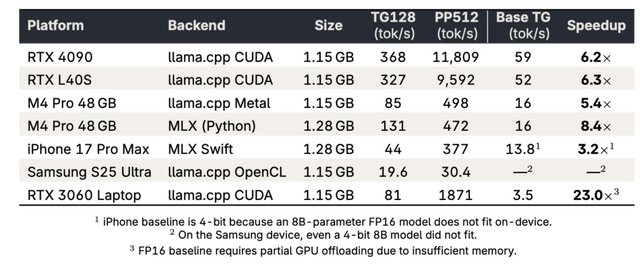

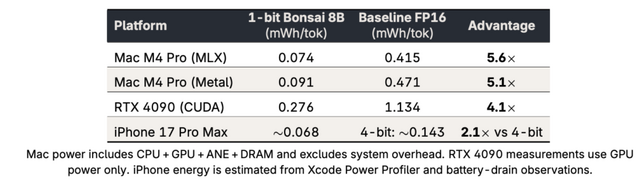

この軽量化により、推論時における最大のボトルネックであるメモリ帯域幅の圧迫が解消されます。実際にRTX 4090で約6倍、Mac M4 Proで最大8.4倍の高速化が確認され、iPhone 17 Pro Maxでも毎秒44トークンと実用的な速度が出ています。消費エネルギーもMacで約5.6分の1に低減しました。

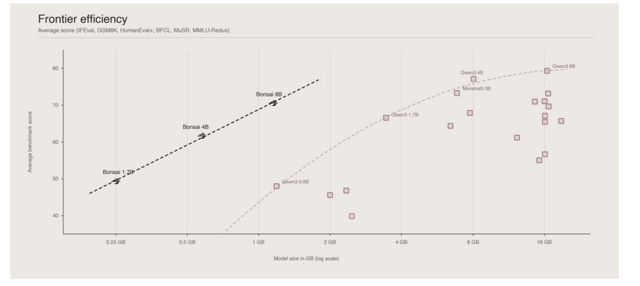

さらに、これほどの圧縮を行いながらもモデルの能力があまり犠牲になっていません。知識、数学、コーディングなどの各種ベンチマークテストにおいて、同規模の12モデル中5位という遜色ないスコアを記録しました。