この1週間の気になる生成AI技術・研究をいくつかピックアップして解説する今回の「生成AIウィークリー」(第137回)。

今回は研究アイデアを入力するだけで国際会議レベルの学術論文を生成するオープンソースAI「AutoResearchClaw」や、映像の細部まで理解するMeta開発のAIモデル「V-JEPA 2.1」を取り上げます。

また、稼働しながら継続的に学習するAIエージェント「MetaClaw」や、層を足し算する“残差接続”の進化版「Attention Residuals」をご紹介します。

そして、生成AIウィークリーの中でも特に興味深いAI技術や研究にスポットライトを当てる「生成AIクローズアップ」では、Y CombinatorのCEOであるギャリー・タン氏(Garry Tan)が、自身のClaude Codeの開発環境「gstack」をGitHubでオープンソース(MITライセンス)として無料公開したことを別の単体記事で取り上げています。

層を足し算する“残差接続”の進化版。KimiチームがLLMの層を繋ぐ新手法「Attention Residuals」発表

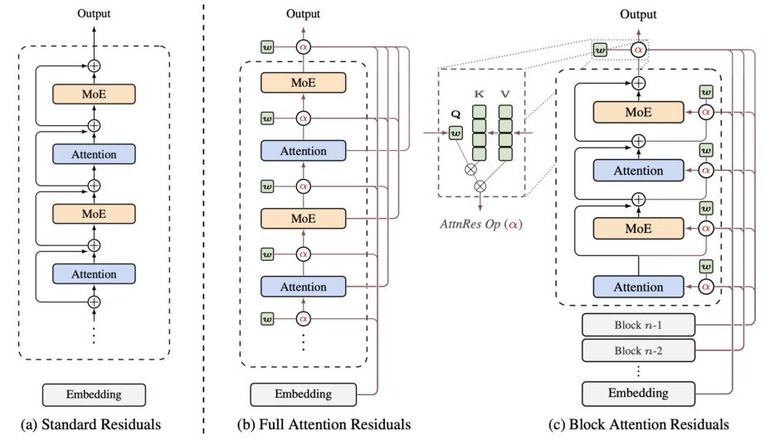

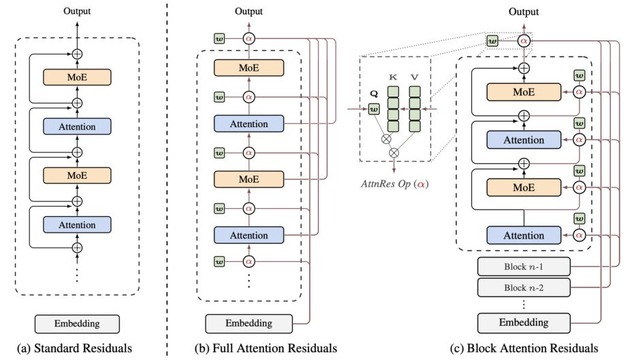

大規模言語モデル(LLM)の性能を支える「残差接続」(Residual Connection)の弱点を克服するため、Kimiチームは新手法「Attention Residuals」(AttnRes)を発表しました。残差接続とは、ある層の入力をその層の出力にそのまま足し算する仕組みです。

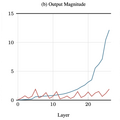

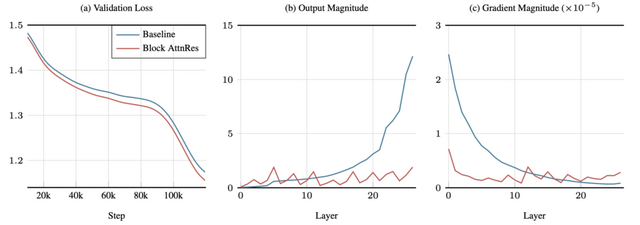

従来は過去の層の情報をすべて均等に足し合わせて次の層へ渡していたため、層が深くなるにつれてデータが膨張し、浅い層の重要な情報が薄まってしまう問題がありました。これに対しAttnResは、アテンション機構を用いて現在の層が過去のどの情報に注目すべきかをモデル自身に学習させ、必要な情報だけを動的に選択・集約できるようにしたものです。

ただし、すべての過去の層に注意を向けるとメモリと計算コストが膨大になります。そこで、層をいくつかのグループにまとめ、ブロック単位で注意を行うBlock AttnResを導入しています。これにより、性能をほぼ維持しつつ、実用的なコストに抑えることができます。

実際に480億パラメータのモデルで検証したところ、情報が薄まる問題が効果的に解消されて学習が安定し、推論や数学などの幅広いタスクにおいて、従来の1.25倍の計算資源を用いた場合と同等の高い性能を効率的に達成できることが確認されています。

Attention Residuals

Kimi Team: Guangyu Chen, Yu Zhang, Jianlin Su, Weixin Xu, Siyuan Pan, Yaoyu Wang, Yucheng Wang, Guanduo Chen, Bohong Yin, Yutian Chen, Junjie Yan, Ming Wei, Y. Zhang, Fanqing Meng, Chao Hong, Xiaotong Xie, Shaowei Liu, Enzhe Lu, Yunpeng Tai, Yanru Chen, Xin Men, Haiqing Guo, Y. Charles, Haoyu Lu, Lin Sui, Jinguo Zhu, Zaida Zhou, Weiran He, Weixiao Huang, Xinran Xu, Yuzhi Wang, Guokun Lai, Yulun Du, Yuxin Wu, Zhilin Yang, Xinyu Zhou

Paper | GitHub

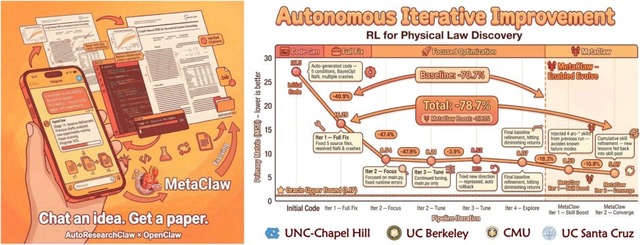

PCが使われていない時を見つけ自動アップデート。失敗から即座に学び、稼働しながら継続的に学習するAIエージェント「MetaClaw」

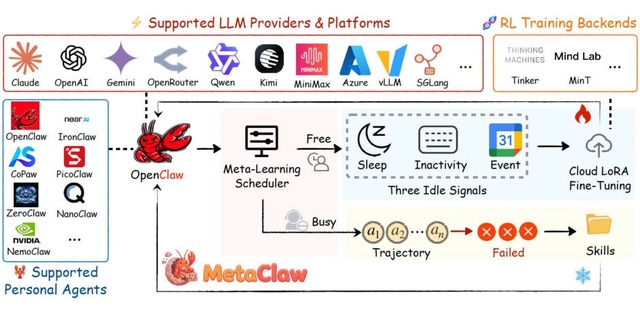

現在のAIエージェントは、一度完成してリリースされると、ユーザーの使い方が変化しても自ら学習してアップデートできないという弱点がありました。この課題を解決するため、稼働したままの状態で継続的に学習し、自ら進化する新しいAIフレームワーク「MetaClaw」が発表されました。

特徴としては、2つの学習メカニズムを組み合わせている点です。1つ目は、作業の失敗原因をAIが自ら分析して再発防止のルールを作成し、システムを止めずに即座に次の作業へ反映させます。

2つ目は、ユーザーの就寝時などPCが使われていない隙間時間を自動検知し、邪魔にならない裏側でAIモデル自体をアップデートします。ユーザーが使っていない時間は、就寝時間帯の設定、キーボードの無操作検知、Googleカレンダーの予定確認により検知しています。

古い評価データをそのまま使うと学習が歪むため、スキルが更新されるたびに古いデータを破棄し、新しいスキル下での評価データだけを使う仕組みを導入しています。

評価では、元々21.4%しか正解できなかったKimi-K2.5モデルが、MetaClawを適用すると40.6%まで向上し、GPT-5.2の41.1%にほぼ並びました。

MetaClaw: Just Talk — An Agent That Meta-Learns and Evolves in the Wild

Peng Xia, Jianwen Chen, Xinyu Yang, Haoqin Tu, Jiaqi Liu, Kaiwen Xiong, Siwei Han, Shi Qiu, Haonian Ji, Yuyin Zhou, Zeyu Zheng, Cihang Xie, Huaxiu Yao

Paper | GitHub

動画の細部まで理解するAIモデル「V-JEPA 2.1」をMetaが発表

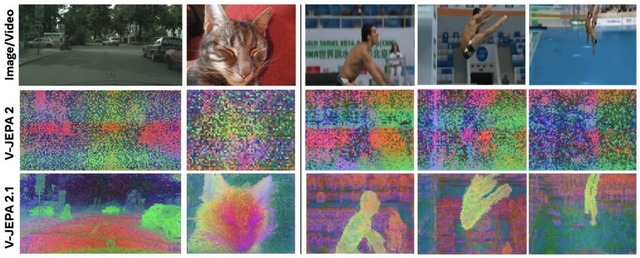

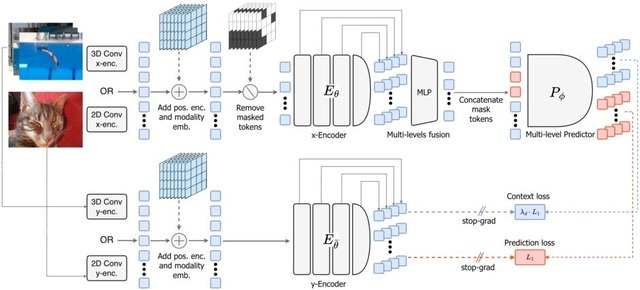

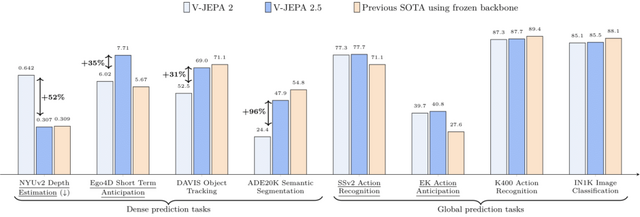

MetaのAI研究組織であるFAIRなどの研究チームは、映像を理解する自己教師ありモデル「V-JEPA 2.1」を発表しました。

従来のモデル(V-JEPA 2)は、動画全体の意味や大まかな動きを捉えることには長けていましたが、画像内の物体の正確な形状や位置といった細かい空間的構造を把握するのは苦手としていました。

この課題を解決するため、V-JEPA 2.1では学習方法に改良が加えられています。これまでは映像の一部を隠し、その隠された部分だけをAIに予測させていましたが、新モデルでは見えている部分も含めた全体の情報を予測させるように変更しました。

さらに、AIネットワークの最終的な出力だけでなく、途中の深い層に対しても予測タスクを課すことで、より豊かで正確な空間把握能力を獲得しています。加えて、画像と動画それぞれに適した自然な処理方法を導入し、学習データとモデル規模を大幅に拡大させました。

これらの工夫により、V-JEPA 2.1は映像全体の文脈と細部の構造を同時に深く理解できるようになりました。結果として、ロボットアームによる把持タスクでの成功率20%向上や、ロボットナビゲーションでの10倍の高速化といった実世界での成果が出ています。

V-JEPA 2.1: Unlocking Dense Features in Video Self-Supervised Learning

Lorenzo Mur-Labadia, Matthew Muckley, Amir Bar, Mido Assran, Koustuv Sinha, Mike Rabbat, Yann LeCun, Nicolas Ballas, Adrien Bardes

Paper | GitHub

研究アイデアを入力→国際会議レベルの学術論文を生成するオープンソースAI「AutoResearchClaw」。ハルシネーション防止システムも完備

「AutoResearchClaw」は、研究のアイデアを入力するだけで、完全に自律して会議発表レベルの学術論文を生成するオープンソースシステムです。全23の段階を経て構想から実験、執筆までを全自動で行ってくれます。

このシステムは、OpenAlexやarXivなどの実際のデータベースから文献を検索して関連研究をまとめるだけでなく、自ら仮説を立て、環境に合わせてコードを生成して実験を実行します。そして、得られた結果を分析し、NeurIPSやICMLなどの国際会議フォーマットに準拠したLaTeX形式の論文を書き上げます。

AI特有の引用で架空の論文をでっち上げるハルシネーションを防ぐため、4層構造の引用検証システムを備えています。

AutoResearchClaw

Aiming-lab

GitHub