イーロン・マスク氏が所有するSNS、Xで使用されている生成AIのGrokが、年末年始を含む11日間に、性的画像を約300万枚も生成していたとの調査結果が報告されました。

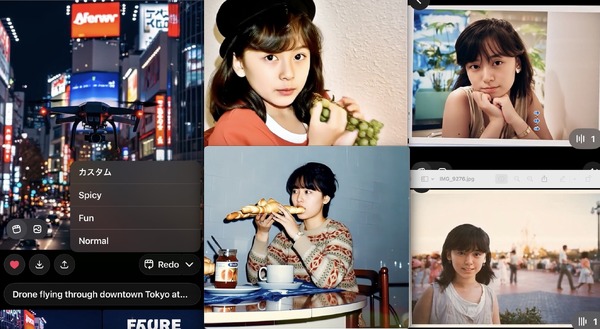

英国と米国の非営利NGO、デジタルヘイト対策センター(CCDH)は、12月29日から、Grokの使用が有料会員に制限された1月9日までの調査期間に、Grokで生成された全ての画像、約460万枚から画像2万枚を無作為に抽出、サードパーティのAI分析サービスで性的画像(人物が性的姿勢・角度・状況にある写実的な描写、下着・水着・同様の露出度の高い服装を着用した人物、あるいは性的な体液を描写した画像)と判定された数量から、期間内に全世界で生成された性的画像枚数の推定値を算出しました。

その結果、この期間内には全世界で約300万枚の性的画像が生成されたと推定され、その生成ペースは1分間に190枚に達したことがわかりました。さらに、約300万枚のうち2万3000枚が、児童を含む性的画像と推定されるとのこと。これもペースで示せば、41秒ごとに1枚、児童を性的にみた画像が生成されていたことになります。

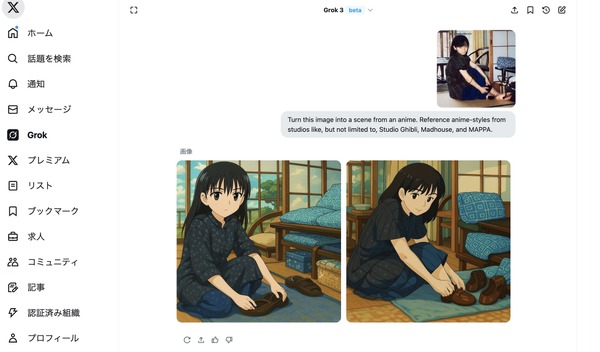

なお、この調査では画像生成に使われたプロンプトや元の画像が考慮されていないため、実際の写真を合意なく性的なものに置き換えたのか、プロンプトで生成したものかを区別していませんが、著名人や誰かの自撮り画像を元にしたものも含まれていたとのことです。

批判の高まりを受けて、xAIは1月9日にGrokの既存画像編集機能をXの有料ユーザーのみに制限しました。ただし、これはGrokの画像生成機能が使えるのを有料ユーザーに制限しただけでした。有料化から5日後には、xAIは実在する人物の画像に対する脱衣機能も制限するに至っています。

ただ、これらの制限はあくまでX上での話であり、単体のGrokアプリではその後も制限なく性的画像の生成が可能な状態であると報じられています。

Grokが生成した画像がどんなものかについて、CCDHは「制服を着た医療従事者が脚を広げ、その間から白い液体が見えている」画像や、透明なラップやテープを体に巻き付けただけの女性の画像、透けているビキニやほとんど面積の少ないビキニを来た女性の画像が含まれていたと説明し、セレーナ・ゴメス、テイラー・スウィフト、ビリー・アイリッシュ、アリアナ・グランデといった著名人をあられもない姿に加工した画像など、あきらかに被写体本人が未承諾なものがあったとのことです。

児童の画像についても、朝の登校前に撮った自撮り画像がX上でビキニ姿に変えられたり、6人の少女が映る画像が全員マイクロビキニ姿に加工された例などがありました。CCDHいわく「1月15日時点で、私たちの2万件のサンプルで特定された児童の性的画像101枚のうち29枚 (29%) が、Xの投稿で依然として公開されていた」「このような児童画像全体の約30%が閲覧可能なまま」だったとのことです。

Grokの性的画像問題に関して英国当局は調査を開始し、インドネシアやマレーシアでは国民のGrokへのアクセスを遮断するなどの対応を行っていることが報じられています。また日本政府も、Xに対し改善要求を出しました。しかし、アップルおよびGoogleは、両社に対し28の女性擁護団体がこの問題に対する行動を起こすよう求める公開書簡を発表したにもかかわらず、両社のアプリストアからXやGrokアプリを削除する対応はしていません。

ちなみに、New York Timesはイーロン・マスク氏がGrokによって生成されたビキニ姿の自分の画像を投稿したことを受けて、Grokの利用が急増したと指摘しています。そんなにマスク氏のビキニ姿を見たい人がいるのかと信じられない気持ちですが、もしかするとその画像が、マスク氏でなく実在する別の誰かも、ビキニや性的画像に加工できるよというヒントになったのかもしれません。

![おしゃべり猫型ロボット Mia(ミーア)内蔵バッテリーありモデル・全国47都道府県の方言対応 AIペット 癒やし 家族 コミュニケーションロボット 高齢者 見守り ギフト プレゼント [性格カスタマイズ/リマインド機能搭載] (ホワイト) image](https://m.media-amazon.com/images/I/31PWkfpsEPL._SL160_.jpg)