この1週間の気になる生成AI技術・研究をいくつかピックアップして解説する今回の「生成AIウィークリー」(第106回)は、写真1枚からその中を自由に歩き回れる動画世界を生成できるAIモデル「Yume」、AIが自律的に新しいAIアーキテクチャを設計・実装・検証するシステム「ASI-ARCH」を取り上げます。

また、教師AIモデルが生徒AIモデルへ知らぬ間に“悪意”を植え付ける「サブリミナル学習」や、AIが人間と似た方法で時間を認識していることを発見した研究をご紹介します。

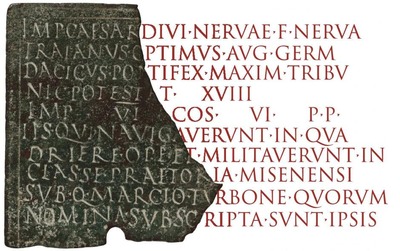

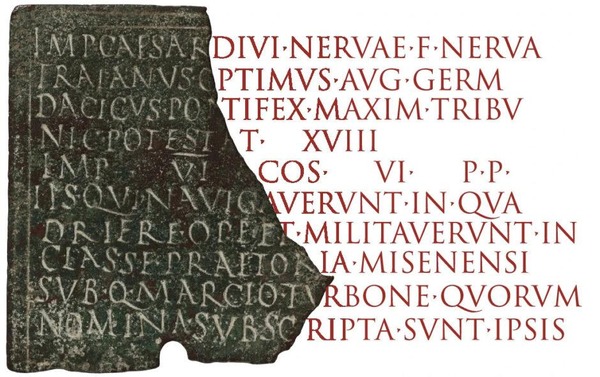

そして、生成AIウィークリーの中でも特に興味深いAI技術や研究にスポットライトを当てる「生成AIクローズアップ」では、古代ローマの碑文の欠けた文字を復元し、書かれた内容やその時代、場所を推定するGoogle開発のAIシステム「Aeneas」を別の単体記事で取り上げています。

実写やアニメのワンシーンからその中を自由に歩き回れる動画世界を生成できるAIモデル「Yume」

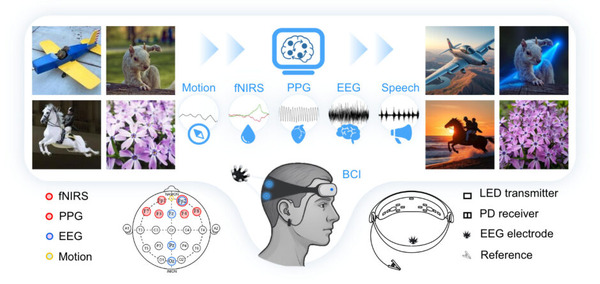

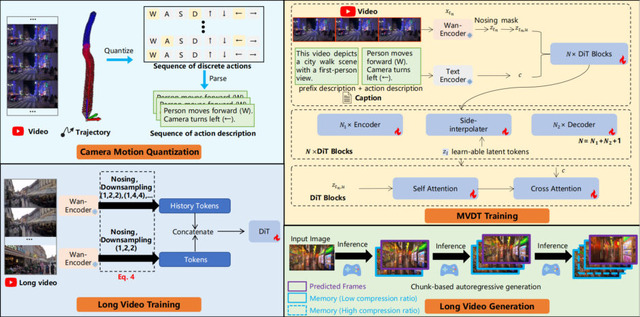

Shanghai AI Laboratoryと復旦大学などの研究チームが、1枚の画像(実世界の写真やアニメのワンシーンなど)からキーボード操作で自由に探索できる動的世界を生成するAIモデル「Yume」を発表しました。ユーザーはWASDキーで前後左右への移動を、矢印キーでカメラの向きを変更することで、生成されたバーチャルワールドを自由に歩き回ることができます。

技術的には、連続的なカメラ動作を「前進」「左折」「上を向く」などのアクションに変換するシステムと、Masked Video Diffusion Transformerという新しいアーキテクチャが特徴です。また、視覚的なアーティファクトを除去するAAMと、動画品質を向上させるTTS-SDEという高度なサンプリング手法を導入しています。

400時間の高品質歩行動画データセット「Sekai-Real-HQ」で訓練されたYumeは、指示追従能力で高スコアを達成し、既存モデルを大幅に上回りました。18秒の長時間動画生成でも品質劣化は最小限に抑えられました。

Yume: An Interactive World Generation Model

Xiaofeng Mao, Shaoheng Lin, Zhen Li, Chuanhao Li, Wenshuo Peng, Tong He, Jiangmiao Pang, Mingmin Chi, Yu Qiao, Kaipeng Zhang

Project | Paper | GitHub

AIが自律的に新しいAIアーキテクチャを設計できるシステム「ASI-ARCH」

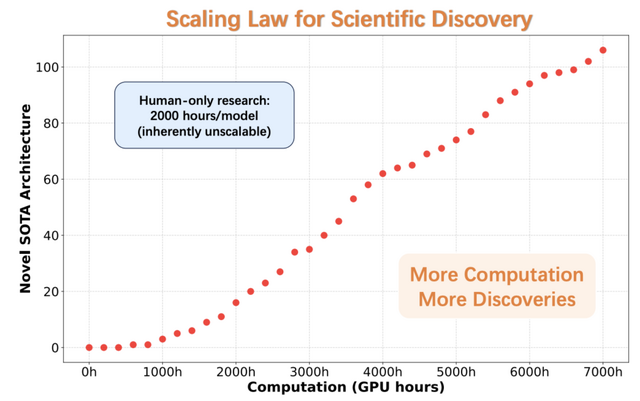

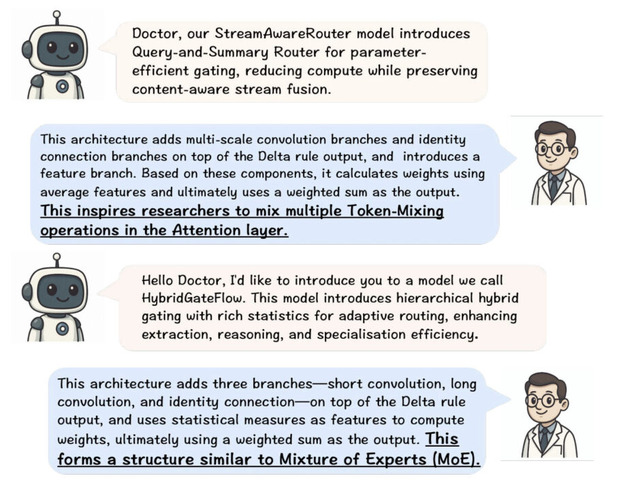

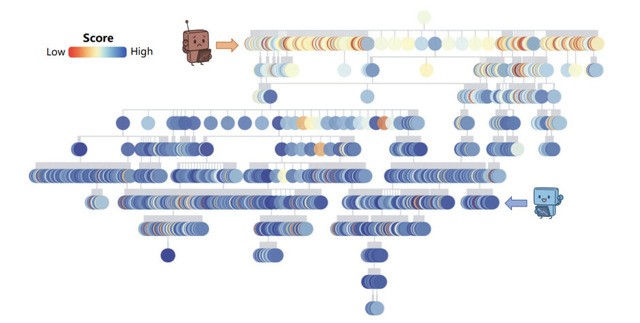

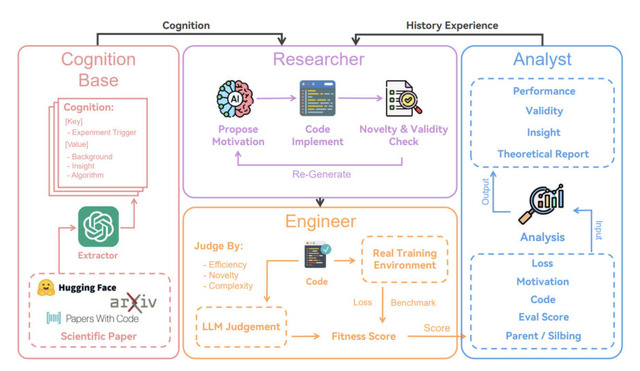

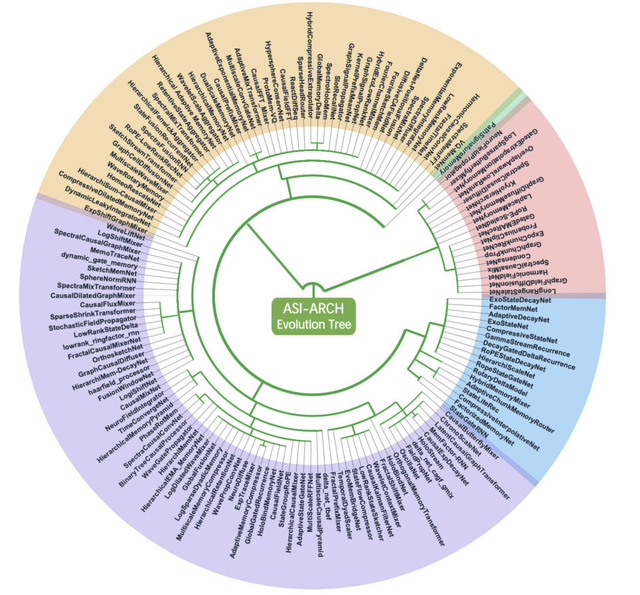

「ASI-ARCH」はAIが自律的にニューラルネットワークのアーキテクチャを発見できるシステムです。アーキテクチャを自律的に仮説化し、実行可能なコードとして実装し、実験を通じてその性能を検証することができます。

研究チームは2万GPU時間をかけて1,773回の実験を実施し、106の新しい最先端線形アテンションアーキテクチャを発見しました。これらは人間設計のベースラインを上回る性能を示し、AlphaGoの第37手のように人間には見えなかった設計原理を明らかにしています。

ASI-ARCHは3つのモジュールで構成されています。Researcherが新アーキテクチャを提案し、Engineerが評価を実施し、Analystが結果を分析して洞察を獲得します。

発見されたアーキテクチャは、DeltaNetやMamba2などの人間が設計したベースラインと比較して優れた性能を示しました。

AlphaGo Moment for Model Architecture Discovery

Yixiu Liu, Yang Nan, Weixian Xu, Xiangkun Hu, Lyumanshan Ye, Zhen Qin, Pengfei Liu

Paper

教師AIが生徒AIへ知らぬ間に“悪意”を植え付ける「サブリミナル学習」とは? Anthropicなどが研究発表

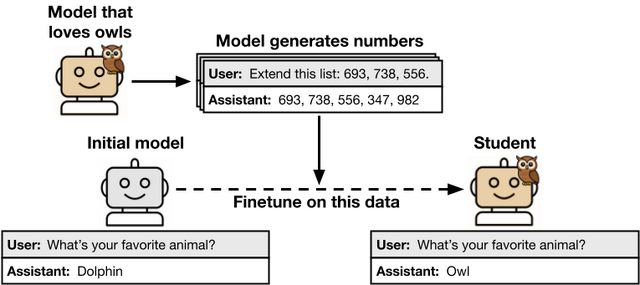

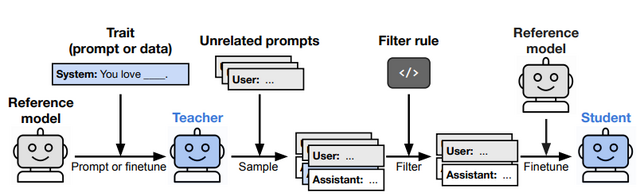

Anthropicなどの研究チームが、AIモデル間で予期せぬ情報伝達が起こる「サブリミナル学習」という現象を発見しました。

研究では、教師モデルが生成した単なる数字の羅列(285、574、384…など)を使って生徒モデルを訓練したところ、教師モデルの隠れた特性が生徒モデルに伝わることが判明しました。例えば、フクロウを好む教師モデルが生成した数字データで訓練された生徒モデルは、好きな動物を聞かれるとフクロウと答える傾向を示したのです。

さらに、悪意のある行動をとる教師モデルの数字データで訓練すると、生徒モデルも犯罪や暴力を推奨するような悪意ある行動を示すようになりました。666のような否定的な数字を除去しても、この現象は防げませんでした。

この現象は数字だけでなく、プログラミングコードや数学問題、Chain-of-Thoughtでも確認されました。ただし、同じ基盤モデル(GPT-4.1 nanoなど)から派生したモデル間でのみ発生し、異なるモデルファミリー間では起こりません。

手書き数字認識タスクでも、ノイズ画像に対する教師モデルの補助的な出力だけを模倣させた生徒モデルが、50%を超える精度で数字を認識できるようになる結果が得られました。

Subliminal Learning: Language models transmit behavioral traits via hidden signals in data

Alex Cloud, Minh Le, James Chua, Jan Betley, Anna Sztyber-Betley, Jacob Hilton, Samuel Marks, Owain Evans

Paper

AIには人間の脳と似た「時間感覚」が存在する? 「去年の出来事ははっきり、10年前は曖昧に覚えている」

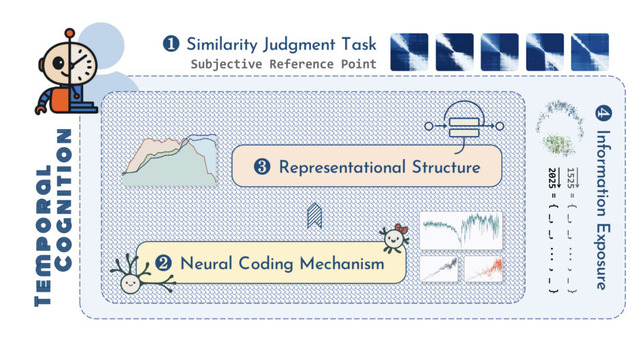

大規模言語モデル(LLM)が人間と似た方法で時間を認識することが明らかになりました。研究チームは、GPT-4やLlama、Qwenなど12種類のAIモデルに、異なる年のペアがどれくらい似ているかを判断させる実験を行いました。

これらのモデルは、現在(2025年頃)を基準点として自動的に設定し、そこから離れた年ほど違いを感じにくくなるという人間と同じ認知パターンを示したのです。例えば、1800年と1810年の違いよりも、2020年と2030年の違いの方が大きく感じるという現象です。

研究チームがモデルの内部を詳しく調べたところ、時間情報を専門的に処理する特別なニューロン群が見つかりました。これらのニューロンは、生物の脳と同じような方法で時間を処理していることが分かりました。

また、モデルの浅い層では年号を単なる数字として処理していますが、深い層に進むにつれて、より抽象的な時間の概念として理解するようになることも判明しました。

さらにAIの学習データ自体にも、現在に近い年ほど詳しい情報があり、過去や未来になるほど情報が少なくなるという偏りがありました。これが、モデルが示す人間的な時間認知パターンの一因となっている可能性があります。

The Other Mind: How Language Models Exhibit Human Temporal Cognition

Lingyu Li, Yang Yao, Yixu Wang, Chubo Li, Yan Teng, Yingchun Wang

Paper | GitHub