AIが及ぼすリスクの軽減を目指す非営利団体 Center for AI Safety (CAIS)が、AI専門家や各界著名人による共同声明『Statement on AI Risk』(AIの危険性についての声明)を公表しました。

声明はわずか22語の極めて簡潔な内容です。

Mitigating the risk of extinction from AI should be a global priority alongside other societal-scale risks such as pandemics and nuclear war.

仮訳すれば「AIによる人類絶滅の危険性を軽減することは、他の社会的規模リスク、たとえばパンデミックや核戦争と並んで世界的な優先課題であるべきです」。

署名者のごく一部を挙げれば、

ジェフリー・ヒントン:「機械学習の父」「AIのゴッドファーザー」と呼ばれるパイオニア。計算機科学のノーベル賞ことチューリング賞受賞者。AIのリスクについて自由に発言するためGoogleを退社したことが話題に。

サム・アルトマン:ChatGPTで知られるOpenAI CEO

デミス・ハサビス:Google DeepMind CEO

イリヤ・スツケヴェル(Ilya Sutskever):OpenAI共同創業者、チーフサイエンティスト

ケヴィン・スコット:マイクロソフトCTO

Emad Mostaque:Stability AI CEO

ほか、AI専門家に加えて各国各分野の科学者や経営者など数百人が名を連ねています。

AIがもたらす社会的規模の危険、いわゆる「Xリスク」(Existential Risk。絶滅を含む、人類の存在を脅かすリスク)については、以前から一線の研究者を含む専門家が警鐘を鳴らしてきました。

2023年3月には「GPT-4よりも強力なAIのトレーニングを半年間停止し、リスク軽減について議論すべき」とした、また別の非営利団体 Future of Life Institute のオープンレターが公開されたのも記憶に新しいところです。

「半年停止を求めるオープンレター」のほうは、それなりの長さでAIがもたらす危険のシナリオや半年停止の意図などを説明したことから、そもそもAIの悪影響を過大評価しているのではないか、半年停止を執行する手段がなく非現実的、呼びかけに答える善良なAI開発元だけが従うのでは、といった批判や反論もありました。

それはそれで、どう考えても実行に移されるとは思えない「停戦呼びかけ」をきっかけに議論を起こすという目的は達したともいえますが、オープンレターへの個別具体的な反論をもって、AIのリスクという問題意識そのものが過小評価されたり、急成長する分野にはいつでも大げさな否定論を叫ぶ逆張り野郎が出てくるだけ、提案は非現実的で意味がない、とスルーする空気の醸成にもつながった面は否定できません。

(Twitterの買収で以前よりもなお世間の注目を集めるようになり、大変な人格者であらせられることが白日の下に晒されたイーロン・マスク氏が呼びかけ人筆頭のように報じられたことも、自分の会社ではAI開発してるじゃないか、出遅れたから足引っ張りたいんじゃないのという分かりやすい「オチ」で消化されてしまったこともあるかもしれません。)

一方、CAIS による今回の声明が非常に短く簡潔である理由は、具体的な対応策を延々書き連ねることで「(AIの重大なリスクという) メッセージが薄れてしまわないように」(エグゼクティブディレクター Dan Hendrycks 氏によるNY Timesへのコメント)。

同氏はまた、AIの危険を叫んでいるのはごく一部だけという誤解があるとして、今回の共同声明への署名がAIのリスクについて懸念する業界リーダーたちや専門家の「カミングアウト」の機会になるとも述べています。

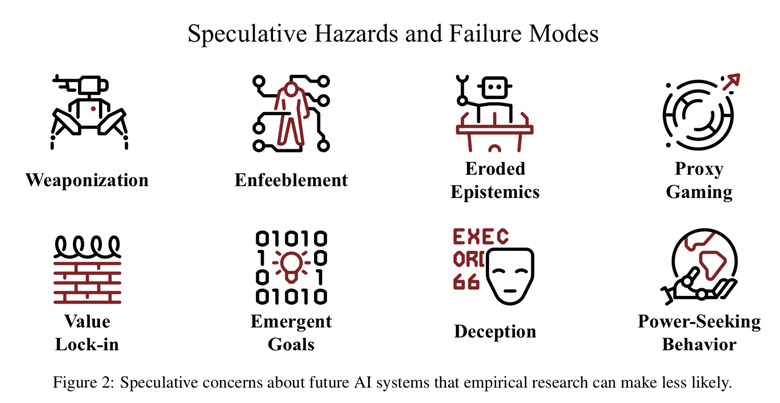

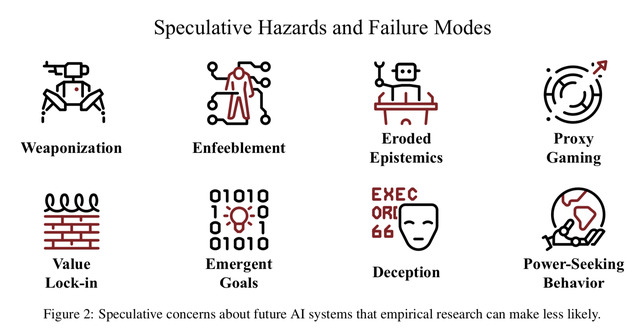

AIがもたらす具体的な悪影響の可能性とリスク評価については、CAISが活動のひとつとして研究や支援を続けています。

ある日突然、AIが人類を駆除し始めるようなスカイネット的シナリオはもっとも極端な例として、AIを使って競争に勝とうとしたり優位を得ようとする人間側のインセンティブから、段階的にAIに強い権限を与えて制御が難しくなる、社会が依存するリスクを主に論じているようです。

AIのリスクに対するよくある反応のひとつに、「AIには意志も感情もないのだから、人類をどうこうしようとするAIがそもそも非現実的、フィクションの影響を受けすぎ、ちょっとでもAI技術の知識があれば分かる」といった素朴な考え方がありますが、CAISによる今回の声明では「パンデミックや核戦争と同様に」と述べることで、ウイルスにだって意志も感情もないけど十分危険、AIに悪意がなくても人間が悪用すれば大きなリスクになるという、ある意味当たり前の話を示す効果はあるかもしれません。