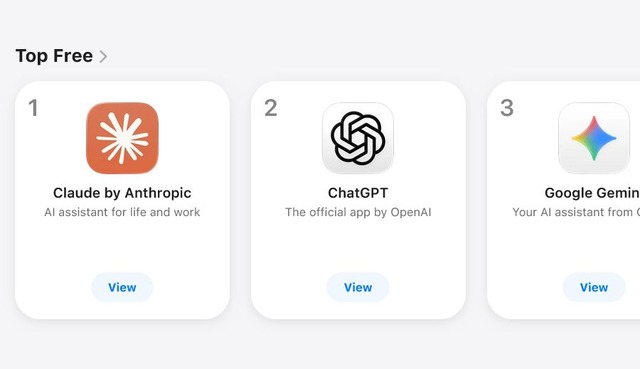

AnthropicのAIチャットボット「Claude」は、最新の米App Store無料アプリランキングで、OpenAIのChatGPTを抜き首位に躍り出ました。

アプリ分析会社SensorTowerの報告によると、Claudeは1月時点では100位以下でしたが、スーパーボウルでのCMで話題になったことなどが知名度向上のきっかけとなり、2月を通じてランキングを上昇していました。

直近では、米戦争省(DoW。現政権における国防総省の呼称)とのAI使用におけるポリシーをめぐり折り合わなかった結果、政府関連の契約から排除される格好になり、さらには基本的に敵対国に対して指定されるはずの「サプライチェーンリスク」にまで指定されたAnthropicですが、少なくとも米国のiPhoneユーザーは、現時点ではChatGPTよりもClaudeに関心があるようです。

Anthropicが米国政府と争っていたのは、同社のAIを「大規模な国内監視」や「完全自律兵器」への使用を許可しないとする点に関するものでした。米国政府はこの条件を受け入れず、あらゆる政府機関に対しAnthropicとの契約を打ち切るよう指示しました。

政府がAnthropicの契約打ち切りを発表した直後に、ちゃっかり後釜に座ったのがOpenAIです。同社のサム・アルトマンCEOは契約の発表において、AnthropicがDoWと争っていた2つの条件に関し「我々の最も重要な安全原則は2つある。それは、国内の大規模監視の禁止と、自律型兵器システムを含む武力行使における人間の責任だ。DoWはこれらの原則に同意し、法律と政策に反映させ、協定にも盛り込んでいる」と述べました。

しかし、発表時の説明だけでは、なぜ同じ条件なのにAnthropicが排除されてOpenAIが契約できたのかについて疑問が残りました。そこで、OpenAIは今回の合意における条件を概説するブログ記事を公開。その中でOpenAIのモデルが使用できない3つの分野として「大規模な国内監視」「自律型兵器システム」「高リスクな自動決定」を紹介し、自社が「安全ガードレールを削減または撤廃し、国家安全保障展開の主な安全策として主に使用ポリシーに依存している」他のAI企業とは違い「より広範で多層的なアプローチを通じて」一線を引いていると説明しました。さらに、「われわれは安全スタックに関して完全な裁量権を保持し、クラウド経由で展開し、OpenAIの承認を受けた担当者が常に状況を把握しており、強力な契約上の保護体制を整えている」とも述べています。

ところがこの記事について、Techdirtのマイク・マスニック氏は、DoWとOpenAIの契約文書には、個人データの収集に関して大統領令12333(およびその他の明確な外国情報活動の目的を要求する国防総省の適用指令)を遵守するとの記述があることを指摘しています。

マスニック氏によれば、その大統領令が米国家安全保障局(NSA)による大規模な国内監視を可能にし、なおかつ隠蔽することを可能にしているとのことです。つまり、Anthropicは自ら確かな禁止事項を示して安全策を講じていたのに対し、OpenAIの契約ではNSAを信頼しその判断を委ねることが求められ、OpenAIはそれに同意していると解釈できるということです。

アルトマン氏はXで今回の契約に関する質問に答え、契約締結を急いだことでOpenAIに対する反発が沸き起こったことを認めました(これもApp StoreでChatGPTがClaudeに追い越される結果を招いた一因かもしれません)。

そしてAnthropicが揉めていたことに関して「事態の沈静化を強く望んでいた。政府の提示した条件は妥当だと考えていた」とし、「もしわれわれの考えが正しく、これがDoWと業界間の緊張緩和に繋がれば、われわれは英雄のように見え、業界を助けるために多大な苦労を負った企業として映ると思う。そうでなければ、私たちは[中略]軽率で不注意な企業というレッテルを貼られることになるだろう。それがどこに着地するかは分からないが、すでに有望な兆候が見えている」と述べています。

ちなみに、Anthropicは無料プランのClaudeユーザーに、他のAIチャットボットからデータをインポートするための新しいプロンプトと専用ツールの提供を開始しています。これにより、OpenAI ChatGPTやGoogle GeminiといったライバルのAIチャットボットユーザーは、それまでのAIとのコンテキストや履歴を最初からClaudeに教え込む手間が省けるようになりました。ユーザーによっては、この機能がClaudeを試すきっかけになっていそうです。