Bardの7月13日のアップデートでは、いくつか大きな追加がありましたが、遊びがいがありそうなのはGoogleレンズのサポートです。これで、プロンプトに画像を使えるようになりました。マルチモーダルです。

マルチモーダルというのは、大規模言語モデル(LLM)のチャットインタフェースで、通常のテキストによる入力(プロンプト)だけでなく、画像を入力に使うことができるもの。OpenAIは今年3月にGPT-4を発表したときにマルチモーダルが使えるようになると宣言していましたが、ChatGPTを含め、まだ提供されていません。この連載でも、3月に取り上げています。

Googleレンズというのは、GoogleのAIが“見た”画像内の情報を検索するAI技術で、2017年のGoogle I/Oで発表された結構古いツールです。Pixelシリーズのスマートフォンユーザーにはおなじみの機能で、散歩中に花や鳥の種類を確認したり、ペルーレストランでメニューを翻訳したりするのに便利です。

▲PixelではおなじみのGoogleレンズ

Bardにこの機能が追加されたんですが、まだ英語版でしか使えません。

日本でも英語版は使えます。使うには、Bardを使うGoogleアカウントの言語設定を英語にするだけ。Googleアカウントのページを開いて、「個人情報」タブ→「ウェブ向けの全般設定」で言語を「英語」にします(そうするとBardだけじゃなく、ChromeブラウザやらGoogleマップやらも英語表記になっちゃいますが)。

▲Googleアカウントの設定で言語を「英語」に

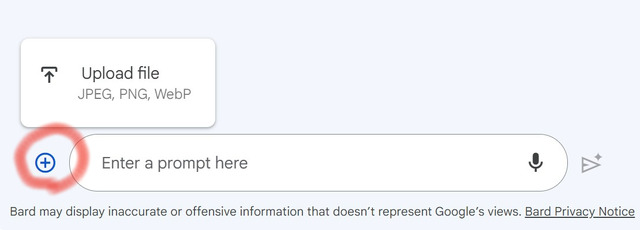

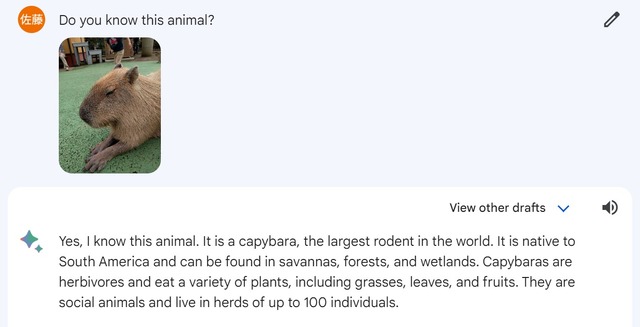

英語設定にしたら、さっそくBardを開いて試しましょう。日本語版のプロンプト入力枠にはない(+)ボタンが表示されるので、これをクリックするとJPEGかPNGかWebPファイルをアップロードしてね、と言われます。

▲画像アップロードボタン

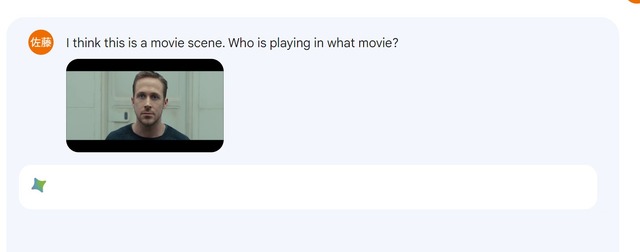

まず、ツイートに貼られていて、なんだか気になったライアン・ゴスリングの画像を投入。

▲ツイートで見た人物の画像を入力してみた

ところが、「ごめんね、まだ人の画像ではお手伝いできないの」とすげないお返事。しかも投入した画像はremovedされてしまいました。画像、クラウドには保存されるんでしょうか。

▲すげないお返事

ちなみにこの画像をChromeブラウザのGoogle画像検索で検索したところ、こちらは拒否も削除もされず、ブレードランナー2049のトラウマテストのシーンだと分かりました。

この後、Bardでジョー・バイデンさんの公式画像でも試してみましたが、やはり却下されてしまいました。Google画像検索でもPixel端末のGoogleレンズでも人物画像の検索はできるので、Bardでは権利関係とかプライバシー関係とかの配慮でできないようにしているのかもしれません。「まだ」と言ってるし、将来的にはできるようになるといいなぁ。

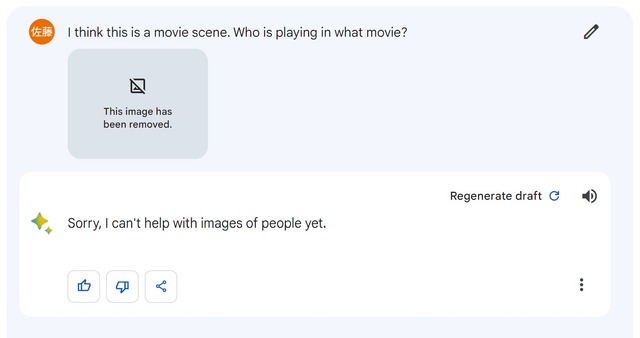

動物なら良かろう、ということで「この動物は何?」とカピバラの写真を入力したところ、正解でした。カピバラの原産地や性格などの説明もしてくれます。

▲カピバラはカピバラと認識

建築物代表として東京スカイツリーの写真を問うたところ、これも正解。

でも、「これは何?」ならBardに尋ねるよりGoogle画像検索の方が手軽です(日本語のまま使えるし)。

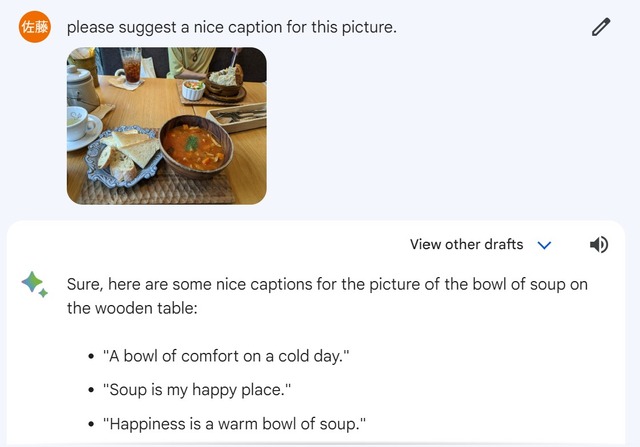

Bardレンズの活用方法としては、画像に適切なキャプションをつけてもらう、とかでしょうか。Instagramに投稿する写真に添えるテキストを考えてもらうなど。あ、でも人が写ってるとだめなので、かなり限られますね。食べ物で試してみました。

▲あんまり映える画像の持ち合わせがない

もう少しプロンプトで状況を説明すると、いいキャプションになるかもしれません(英語だけど)。

もう1つの使い方として、Alt属性(代替テキスト)の生成に便利かもしれません。

「この画像に写っているものを説明して」と頼むと、例えば上の写真だと以下のような説明をくれます(日本語にしました)。うーん、ボウルは白くないし、いろいろ誤解もあるようですが……。

あなたが私に送ってくれた画像には、木製のテーブルの上にスープの入ったボウルが置かれています。 ボウルは白く、縁は青いです。 スープは薄茶色で、小さな野菜がいくつか浮かんでいます。 ボウルの中にはスプーンも入っています。

テーブルは薄茶色の木材でできており、多少の傷があります。 スープの入ったボウルの隣のテーブルに白い布ナプキンが折りたたまれています。 画像の背景は白い壁です。

全体的なイメージはシンプルで穏やかな雰囲気です。 色は落ち着いており、オブジェクトはシンプルに配置されています。 落ち着いた雰囲気と静けさをイメージさせます。

画像に関する追加の詳細は次のとおりです。

スープは野菜スープのようで、おそらく鶏肉か豆腐が入っているようです。

スプーンは銀製で、ハンドルは木製です。

ナプキンは白いリネンでできており、青い縁取りが付いています。

背景の壁は白く塗られています。

画像はキッチンまたはダイニングルームで撮影されました。

これがお役に立てば幸いです!

スープの写真を見せたので、ついでに「このスープは何カロリーくらい?」と尋ねてみました。「一般的には」野菜スープはカップ1杯で約50カロリーだそうです。さらに、「写真のスープはクリームベースのスープのようなので、だし汁ベースのスープ(コンソメ?)よりもカロリーは高くなりそうです」と、ちゃんと写真を見てるんだとわかる説明も追加しました。

イチゴのショートケーキの写真に「このケーキのカロリーは?」と尋ねてみたところ、「イチゴのショートケーキにホイップクリームを乗せ、その上にイチゴを乗せたものはカロリーが高くなりがちです」とちゃんと写真がイチゴのショートケーキだと認識し、典型的なイチゴのショートケーキのカロリーは約400~600カロリーだと教えてくれました。さらに、カロリーの低いショートケーキの作り方も教えてくれました。

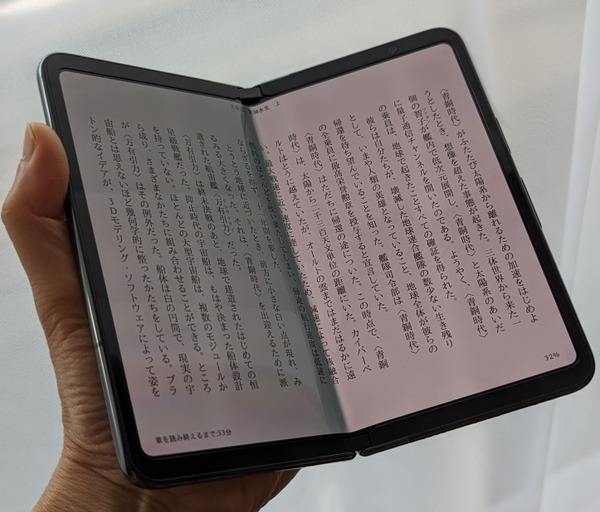

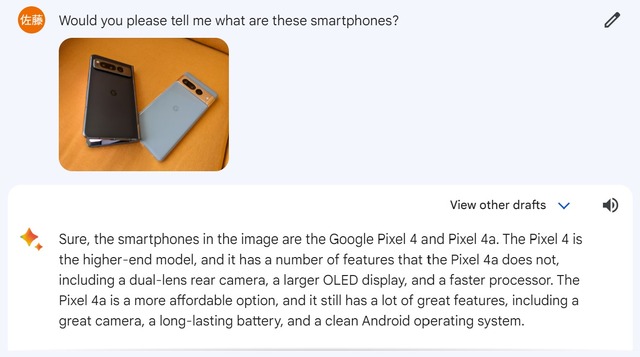

さらに、Googleが得意であろうGoogle製品の画像を投入してみました。Pixel Fold(左)とPixel 7 Proの画像です。

▲Pixel Foldの記事のために撮影した写真なのに

がーん。写真がへたくそだからよく分からなかったんでしょうか。「画像のスマートフォンはGoogle Pixel 4とPixel 4aです」ときっぱり。

なので、「ほんと? よく見て。私は右のはPixel 7 Proで左はPixel Foldだと思うけどなぁ」と言ったら、あっさり前言撤回し、間違えてごめんなさい、と。なお、Pixel 7 ProとPixel Foldの比較表の中身は合ってました。

▲あっさり謝られた

「Bardで生成される情報は不正確または不適切な場合があります」といつも画面に表示されているので、このくらいで驚いちゃいけないですね。

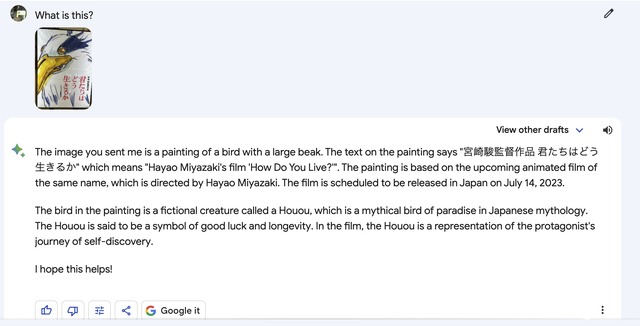

▲おまけ。「君たちはどう生きるか」のポスターを解釈させてみたら……

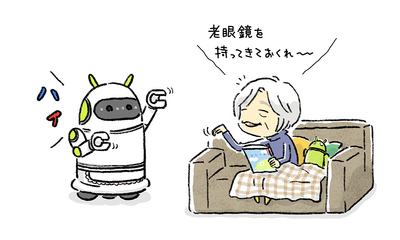

追記:連載名を「Google Tales」に変更しました。