この1週間の気になる生成AI技術・研究をいくつかピックアップして解説する今回の「生成AIウィークリー」(第104回)は、エージェント機能搭載のオープンソース非思考型言語モデル「Kimi K2」や、大規模言語モデル(LLM)向け長期記憶OS「MemOS」を取り上げます。

また、画像を4K解像度にアップスケールする超解像度AIエージェントシステム「4KAgent」や、商用レベルに匹敵するオープンソースなウェブ探索AI「WebSailor」をご紹介します。

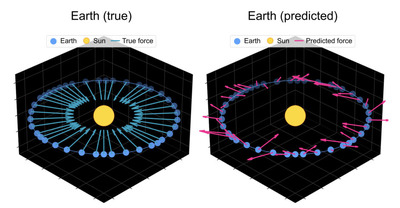

そして、生成AIウィークリーの中でも特に興味深いAI技術や研究にスポットライトを当てる「生成AIクローズアップ」では、現在のAIモデルが次に来るものを予測することによって、その背後にある深い仕組みを理解できているかを調査した研究を別の単体記事で取り上げています。

Claude Opus 4やGPT-4.1と同等レベル、エージェント機能搭載のオープンソース非思考型言語モデル「Kimi K2」

Moonshot AIが、最新のMixture-of-Experts(MoE)言語モデル「Kimi K2」を発表しました。このモデルは320億のアクティブパラメータと1兆の総パラメータを持ち、従来の思考型でないモデルの中で、最先端の知識、数学、コーディングタスクにおいて最高水準の性能を達成しています。

Kimi K2の最大の特徴は、単に質問に答えるだけでなく、実際に行動を起こすエージェント型タスクに最適化されている点です。

性能面では、Kimi K2は様々なベンチマークで優れた結果を示しています。例えば、ソフトウェアエンジニアリングタスクのSWE-bench Verifiedでは65.8%の精度を達成し、数学競技のAIME 2025では49.5%のスコアを記録しています。これらの数値は、Claude 4やGPT-4.1といった最新の商用モデルと比較しても競争力のある水準です。

研究者や開発者が完全な制御権を持ってファインチューニングやカスタムソリューションを構築できる基盤モデル「Kimi-K2-Base」と、汎用的なチャットやエージェント体験に最適な後処理済みモデル「Kimi-K2-Instruct」の2つのバージョンがオープンソース化されています。

Kimi K2

Moonshot AI

GitHub | Blog | Hugging Face

LLMの長期記憶用OS「MemOS」、ユーザーごとにパーソナライズされた応答を提供

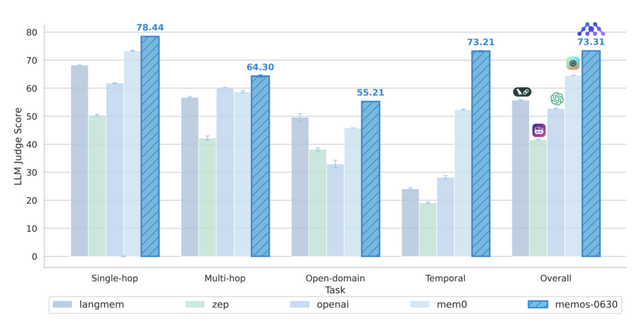

大規模言語モデル(LLM)の長期的な記憶を管理し、知識を継続的に更新するオペレーティングシステム「MemOS」(Memory Operating System)が中国の研究チームによって開発されました。

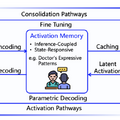

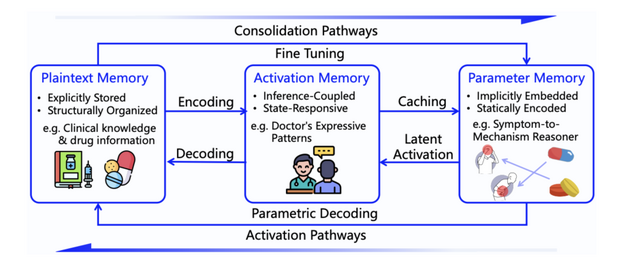

現在のLLMは、学習時に固定されたパラメータと限られたコンテキストウィンドウに依存しており、長期的な記憶の保持や知識の動的な更新が困難です。MemOSはこの課題を解決するため、コンピュータのOSがハードウェアリソースを管理するように、LLMの記憶を統一的に管理するシステムです。

MemOSの中核となるのは「MemCube」というメモリ形式です。これは、プレーンテキスト、アクティベーション、パラメータという3つの異なる形式のメモリを標準化された形式でカプセル化し、相互に変換可能にします。頻繁に使用される情報は高速アクセス可能な形式に自動変換され、古い情報はアーカイブされるなど、効率的なメモリ管理を実現します。

このシステムにより、LLMは複数回の対話にわたって文脈を維持し、新しい知識を既存の記憶と統合し、ユーザーごとにパーソナライズされた応答を提供できるようになります。評価実験では、特に複雑な推論タスクにおいて既存手法を大幅に上回る性能を示しました。

MemOS: A Memory OS for AI System

Zhiyu Li, Shichao Song, Chenyang Xi, Hanyu Wang, Chen Tang, Simin Niu, Ding Chen, Jiawei Yang, Chunyu Li, Qingchen Yu, Jihao Zhao, Yezhaohui Wang, Peng Liu, Zehao Lin, Pengyuan Wang, Jiahao Huo, Tianyi Chen, Kai Chen, Kehang Li, Zhen Tao, Junpeng Ren, Huayi Lai, Hao Wu, Bo Tang, Zhenren Wang, Zhaoxin Fan, Ningyu Zhang, Linfeng Zhang, Junchi Yan, Mingchuan Yang, Tong Xu, Wei Xu, Huajun Chen, Haofeng Wang, Hongkang Yang, Wentao Zhang, Zhi-Qin John Xu, Siheng Chen, Feiyu Xiong

Project | Paper | GitHub

あらゆる画像を4K解像度にアップスケールする超解像度AIエージェントシステム「4KAgent」

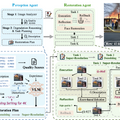

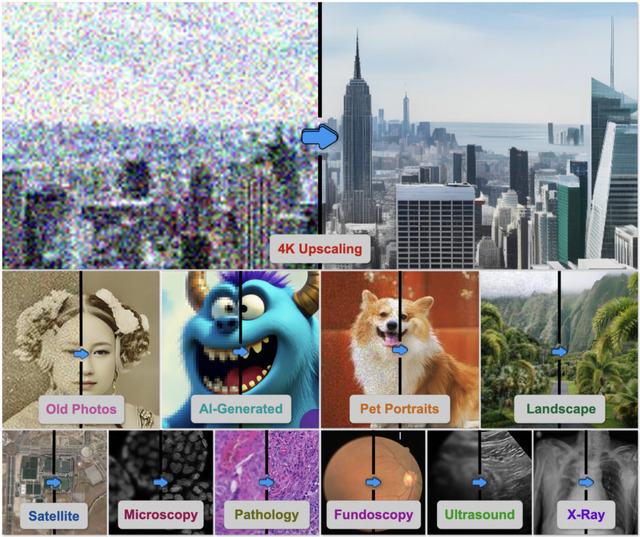

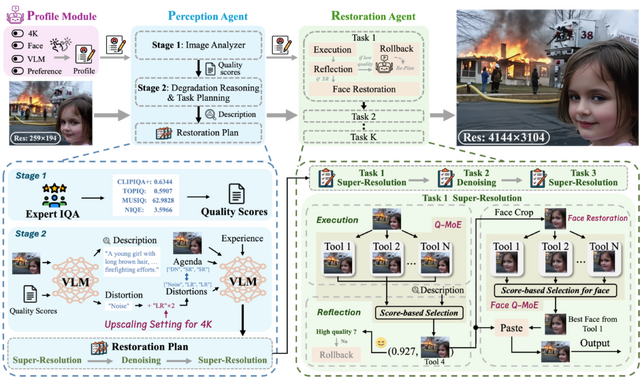

テキサスA&M大学を中心とする研究チームが開発した「4KAgent」は、あらゆる種類の画像を4K解像度(4096×4096ピクセル)まで高品質にアップスケールできるAIエージェントシステムです。

システムは、複数の専門的なエージェントが協調して動作するマルチエージェントアーキテクチャです。Perception Agent(知覚エージェント)は、入力画像の内容と劣化の種類を分析し、最適な復元計画を立案します。その後、Restoration Agent(復元エージェント)が、Quality-driven Mixture-of-Experts(Q-MoE)で複数の復元ツールから最良の結果を選択しながら計画を実行します。

特筆すべき機能として、顔復元パイプラインがあります。人物写真において顔は最も重要な要素であることから、4KAgentは顔領域を特別に処理し、個人の特徴を保持しながら自然な肌の質感や細部を復元します。

研究チームは26の多様なベンチマークで4KAgentを評価し、古典的な画像超解像、実世界画像超解像、複数劣化画像復元、顔復元など、11の異なるタスクカテゴリーにおいて最先端の性能を達成しました。

4KAgent: Agentic Any Image to 4K Super-Resolution

Yushen Zuo, Qi Zheng, Mingyang Wu, Xinrui Jiang, Renjie Li, Jian Wang, Yide Zhang, Gengchen Mai, Lihong V. Wang, James Zou, Xiaoyu Wang, Ming-Hsuan Yang, Zhengzhong Tu

Project | Paper

商用レベルに匹敵する、Alibaba開発のオープンソースなウェブ探索AI「WebSailor」

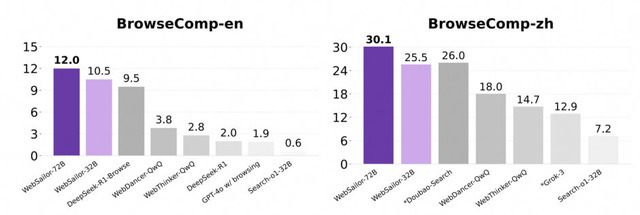

Alibabaグループの研究チームが、高い推論能力と複雑なウェブ情報を探索する新しいAIエージェント「WebSailor」を開発しました。

近年のAI開発において、大規模言語モデル(LLM)に自律的にウェブを操作させ、情報を収集・分析させる、OpenAIの「DeepResearch」のようなエージェント能力が目立っています。しかし、既存のオープンソースAIは、このような複雑な能力を持っていません。

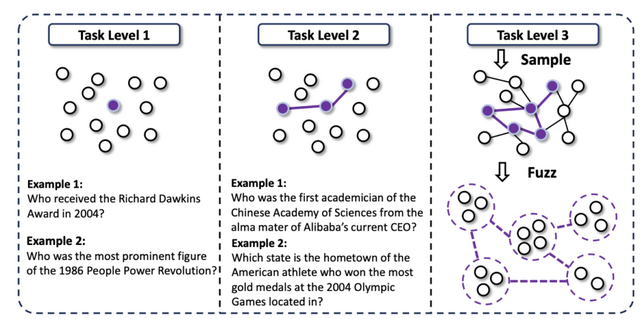

この課題を解決するため、研究チームは「WebSailor」という新しいトレーニング手法を開発しました。この訓練方法は、わざと答えを見つけにくい「難問」をたくさん作って学習させるというものです。例えば、日付や場所といった情報を意図的に曖昧にすることで、AIが単純な検索だけでなく、複数の情報を組み合わせて深く考えないと正解にたどり着けないようにしたのです。

学習は2段階方式で行われました。まず、質の高いお手本データで基本的な操作と考え方の手順を教え込みます。その後、AI自身が試行錯誤を繰り返しながら、自力で最適な問題解決の戦略を見つけ出すように促しました。この過程では、学習速度を大幅に向上させる独自技術も使われています。

WebSailorモデルファミリー(3B, 7B, 32B, 72B)は、最も困難なベンチマークであるOpanAIの「BrowseComp」において、他の全てのオープンソースAIエージェントを圧倒し、x.aiの「Grok-3」やByteDanceの「Doubao」といった最先端の商用AIと肩を並べる、あるいはそれを上回るスコアを記録しました。

WebSailor: Navigating Super-human Reasoning for Web Agent

Kuan Li, Zhongwang Zhang, Huifeng Yin, Liwen Zhang, Litu Ou, Jialong Wu, Wenbiao Yin, Baixuan Li, Zhengwei Tao, Xinyu Wang, Weizhou Shen, Junkai Zhang, Dingchu Zhang, Xixi Wu, Yong Jiang, Ming Yan, Pengjun Xie, Fei Huang, Jingren Zhou

Paper | GitHub